�Ľ�BP������ģ�ͼ����ȶ��Է���

�Ź����

(�����ʵ��ѧ ��������ͨ�Ž������ص�ʵ���ң�������100876)

ժ Ҫ����Դ�ͳBP�㷨�����������ѧϰ��������������ֲ���С���ȱ�㣬���һ�ֻ��ڱ�����ݺ�����б�ȺͶ�̬���ڲ�ͬѧϰ���ʵ�BP�Ľ��㷨�����ڴ˻����ϲ���Lyapunov�ȶ���ԭ�������Ľ��㷨�������ԡ����㷨�ۺϿ�������ѵ����ʽ��ѧϰ�ʵIJ��㣬����µĸ���������ͬʱ����һ�ֲַ㶯̬������ͬѧϰ�ʵ��·�����������������������ѵ�����Լӿ촫ͳBP�㷨�������ٶȺͱ�������ֲ���Сֵ�㡣�ڴ˻����ϣ������㷨Ӧ���ڴ��ֱ���ȱ��ͼ�����У����ȽϸĽ��㷨�봫ͳ�㷨��ȱ�ݼ���е����ܲ������о�����������øĽ��㷨�ܹ����ȱ��ʶ���ʣ�����ٶȿ죬��������ְ������������ʵʱ��Ҫ����һ����֮��Ч�� ������

�ؼ��ʣ�BP�����磻ȱ�ݼ�⣻����������Lyapunov�ȶ���

��ͼ����ţ�TP183 ���ױ�־�룺A ���±�ţ�1672-7207(2011)01-0115-10

Improved BP neural network model and its stability analysis

ZHANG Guo-yi, HU Zheng

(Key Laboratory of Universal Wireless Communications of Ministry of Education,

Beijing University of Posts and Telecommunications, Beijing 100876, China)

Abstract: As for shortcomings of classical BP algorithm such as bad anti-jamming ability, low learning rate and easy plunging into local minimum, a new kind of improved BP algorithm was proposed with varying slope of activation function and dynamically adjusting different learning rates. Moreover, the convergence of this improved algorithm was analyzed based on the principle of Lyapunov stability. Considering the deficiency of network training and insufficient learning rate, a new composite error function was invented. A new method of dynamic adjustment of different learning rate was adopted to accelerate the convergence of classical BP algorithm, and to avoid plunging into the local minimum point. The proposed algorithm was applied to the inspection of the surface defective image of steel strips and compared with traditional algorithm with defect detection performance parameters. The results show that the improved BP algorithm has many merits such as high inspection speed, high discrimination and real-time capacity which can satisfy the demand of defect detection on steel plate surface, so it is an effective method.

Key words: BP neural network; defect detection; composite error function; Lyapunov stability

δ����ͨ�����罫��һ�����ڡ��칹������ģʽ����Ҫ�ܹ�ʵʱ��֪��Χ�����绷����ͨ�����������������⣬ʵʱ����ͨ����������ã����ܵ���Ӧ���������ı仯��ͬʱ�����߱��ӱ仯��ѧϰ����������������δ���ľ����С�����������£�Ѱ��һ���ܹ�ʵʱ��֪���绷���仯��ʵ������Ի�������Ӧ�ķ������Ե���Ϊ��Ҫ���˹�������������Ϊһ������ѧ�ƣ����������㷺Ӧ����ͨ������(�����������á����Ż����Թ���)��ҵ����(��ȱ��ʶ�������)�У��������е�ʵʱ�ԡ��ݴ��Ժ�ѧϰ�Ե�����Ϊ����������Ľ���ṩ����Ч�����ۺͼ���֧�š�Ȼ����Ŀǰ���ձ���û�������洫����BPѧϰ�㷨����Ҫ����2�����⣬�������ٶ�����������ֲ���С������������ģʽʶ���еķ�չ��������������ṹ���Ż����������ѧϰ���ؽ����һ��������� ��[1-2]��Ŀǰ����ģ�͵ĸĽ���Ҫ��������ṹ��ѧϰ�㷨�Ľ�2�����档BP����ṹ�ĸĽ���Ҫ�ڻ�����ʽ��ת�������Լ�������ڵ�ȷ��棬���㷨�Ľ���Ҫͨ���������������������ĵ����Լ������������㷨���ϵ�������������ܡ��ڴˣ�����������Ҫͨ�������˸�������������ֲ���С��ͬʱ����һ�ֲַ������ͬѧϰ�ʵ��·������ӿ������ٶȣ����һ���µ�ѧϰ�㷨�����ڴ˻����ϲ���Lyapunov�ȶ���ԭ�������Ľ��㷨�������ԡ�

1 ��ͳBP�㷨

�����3��BP����Ϊ������������㡢���������������Ԫ�����ֱ�ΪN��M��L����Ӧ����������������Ϊ , 1��k��P��ʵ���������Ϊ

, 1��k��P��ʵ���������Ϊ �������������Ϊ

�������������Ϊ ������㵽�����������ȨֵΪwij(1��i��N, 1��j��M)��������������������ȨֵΪvjt(1��j��M, 1��t��L)�����������Ԫ�������ֵΪ

������㵽�����������ȨֵΪwij(1��i��N, 1��j��M)��������������������ȨֵΪvjt(1��j��M, 1��t��L)�����������Ԫ�������ֵΪ (1��j��M)����������Ԫ�������ֵΪ

(1��j��M)����������Ԫ�������ֵΪ (1��t��L)��g(x)��f(x)�ֱ�Ϊ������������Ĵ��ݺ�������mΪѵ������ĵ�������������Ȩֵ��ʵ���������m�ĺ�����

(1��t��L)��g(x)��f(x)�ֱ�Ϊ������������Ĵ��ݺ�������mΪѵ������ĵ�������������Ȩֵ��ʵ���������m�ĺ�����

�õ�k���������� ������Ȩֵwij����ֵ

������Ȩֵwij����ֵ �������������Ԫ������

�������������Ԫ������ ��Ȼ����

��Ȼ���� ͨ��g(x)���ݺ����������������Ԫ�����

ͨ��g(x)���ݺ����������������Ԫ����� ��

��

��j=1, 2, ��, M (1)

��j=1, 2, ��, M (1)

��j=1, 2, ��, M (2)

��j=1, 2, ��, M (2)

ͬ���������������� ������Ȩֵvjt����ֵ

������Ȩֵvjt����ֵ ������������Ԫ������

������������Ԫ������ ��Ȼ����

��Ȼ���� ͨ��f(x)���ݺ���������������Ԫ����Ӧ

ͨ��f(x)���ݺ���������������Ԫ����Ӧ ��

��

��t=1, 2, ��, L (3)

��t=1, 2, ��, L (3)

��t=1, 2, ��, L (4)

��t=1, 2, ��, L (4)

���������ѵ��������������ʵ�����ֵ ����������ֵ

����������ֵ ���ȫ�־���������ʾΪ��

���ȫ�־���������ʾΪ��

(5)

(5)

ʽ�У� ����ʾ�����m�ε���ʱ������t����Ԫ����

����ʾ�����m�ε���ʱ������t����Ԫ����

���ڴ�ͳBP�㷨��ͨ��ѡ����Sigmoid�ͺ�����Ϊ������������Ĵ��ݺ�������

(6)

(6)

ʽ�У� ��

��

���Ż���������˵��BP�㷨��һ���ݶ��½�������ͳBP�㷨�е�ѧϰ�ʾ����ݶ��½����IJ�����BP�㷨���������ÿ�ε��ڵķ��ȣ�����һ�����������������ȵ�ѧϰ�� ���С��ڴ�ͳBP�㷨�У��������������㻹��������㣬��������Ȩֵ����ֵ���������������У�ѧϰ��

���С��ڴ�ͳBP�㷨�У��������������㻹��������㣬��������Ȩֵ����ֵ���������������У�ѧϰ�� ���ǹ̶������[1-2]��

���ǹ̶������[1-2]��

2 ��ͳBP�㷨�IJ���

��ʵ��Ӧ���У���ͳBP�㷨��Ҫ�������¼�������[2-3]��

(1) ѧϰ�㷨�������ٶȱȽ������ڴ���ͼ��ȱ�����������һ���Ƚϸ��ӵ�����ʱ������ϵͳʵʱ��Ҫ��ܸߣ����Ҫ��ѧϰ�㷨�������ٶ�Ҫ���졣

(2) ������ֲ���Сֵ��BP��������ݶ��½�����ѵ���Ǵ�ijһ��ʼ�㿪ʼ��б���ﵽ������Сֵ�����ڸ������磬������Ϊ��ά�ռ�����棬�������ѵ�������У���������ijһ�ֲ���Сֵ����Ȼ��ͳ�㷨��Ȩֵ����ʱ�������µij������Ա�������ֲ���Сֵ����Ч���������ԡ�

(3) ����������IJ����Լ���������Ԫ����ѡȡ��������ָ�������Ǹ��ݾ���ѡȡ����ˣ����������кܴ�������ԣ�Ҳ����������ѧϰ��ʱ�䡣

(4) �����ѧϰ��������в��ȶ��ԣ��¼����������Ӱ�쵽��ѧ���������

3 �µ�BP�Ľ��㷨

3.1 ����ѵ����ʽ�����ݺ����ĸĽ�

���������ֱ���ȱ�ݼ��ϵͳ�У�����ѵ������ʱ�����������϶࣬���Ҿ���һ���������ظ����������ԣ���BP�Ľ��㷨�У����Բ��÷�����������ѵ����ʽ���������Ȱ�����P��ѵ��������Ϊn�飬ÿ���������ΪPi(1��i��n)��Ȼ���Pi��������������ѵ������ÿ������ѭ������1��ѧϰ���ٵ���ѧϰ�ʣ�������ÿ����1�������͵���1��ѧϰ�ʡ����÷�����������ʽѵ��������ŵ��ǣ�����ʹ��ͬѧϰ����ÿ������ͼ��ѭ��ѵ����ɺ�õ��ʵ����������ܼ�С����ѧϰ�ʵ�ʱ�䡣��ˣ�������������ѵ����ʽ�У����ڸ�����Pi (1��i��n)��ѵ��������������ʵ�����ֵ( )���������ֵ(

)���������ֵ( )���ȫ�־���������ʾΪ��

)���ȫ�־���������ʾΪ��

(7)

(7)

���У� ����ʾ������t����Ԫ����

����ʾ������t����Ԫ����

ͬʱ�������µ�BP�Ľ��㷨������ѡ���� Ϊ��б�Ȳ�����˫������S�ͺ�����Ϊ������Ĵ��ݺ�������

Ϊ��б�Ȳ�����˫������S�ͺ�����Ϊ������Ĵ��ݺ�������

��

�� (8)

(8)

�ô��ݺ������� Ϊ��б�Ȳ����ĵ����������н纯�������Ļ�����������

Ϊ��б�Ȳ����ĵ����������н纯�������Ļ�����������

��

�� ��

�� ��

��

(9)

(9)

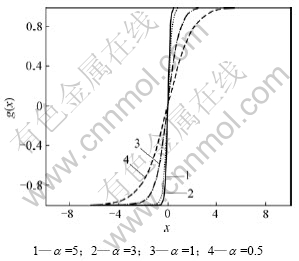

ͼ1��ʾΪ��б�Ȳ��� ȡ5��3��1��0.5��4����ֵͬʱ�Ĵ��ݺ���

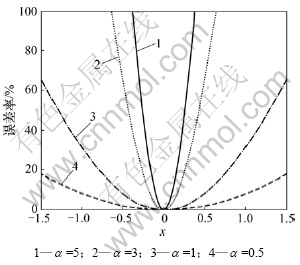

ȡ5��3��1��0.5��4����ֵͬʱ�Ĵ��ݺ��� ���ߣ�ͼ2��

���ߣ�ͼ2��

ʾΪ�� ���Աƽ����ݺ���ʱ������ʡ�

���Աƽ����ݺ���ʱ������ʡ�

ͼ1�к�����IJ���ȡ0.1��ͼ2�к������ ����ȡ0.01��������ļ��㹫ʽΪ�� ����ͼ1��ͼ2

����ͼ1��ͼ2

���Կ����� ԽС�������Դ��ݺ���g(x)Խ�ӽ������Ժ���

ԽС�������Դ��ݺ���g(x)Խ�ӽ������Ժ��� ���������Աƽ��������ҲԽС���������ϴ��ݺ����Ļ������ԣ��������������

���������Աƽ��������ҲԽС���������ϴ��ݺ����Ļ������ԣ�������������� ����ֵ

����ֵ ������Դ��ݺ����Լ���б�Ȳ���

������Դ��ݺ����Լ���б�Ȳ��� �dzɱ����ġ�Ϊ�˻��Ѹ��ٵ�ѵ��ʱ��ͼ���ÿ��ѵ���ļ��������������ʹ��ݺ�����

�dzɱ����ġ�Ϊ�˻��Ѹ��ٵ�ѵ��ʱ��ͼ���ÿ��ѵ���ļ��������������ʹ��ݺ����� ��ʹ����������������������棻������

��ʹ����������������������棻������ ʹ����������������������������磬����һ���̶��ϴ���˶�������������ȱ�ݼ��ʶ��Ӧ���ϵ����ƣ���ˣ�����ѡ��1�����ݺ��������б��

ʹ����������������������������磬����һ���̶��ϴ���˶�������������ȱ�ݼ��ʶ��Ӧ���ϵ����ƣ���ˣ�����ѡ��1�����ݺ��������б�� ����Ȩ������ѵ�����ٶȺ�ȱ�ݼ���Ч��[4-5]��

����Ȩ������ѵ�����ٶȺ�ȱ�ݼ���Ч��[4-5]��

ͼ1 ���ݺ�������

Fig.1 Transfer function curves

ͼ2 ���Աƽ����ݺ����������

Fig.2 Error rate of linear approximation transfer function

3.2 �������������

BP�㷨�������������ƽ���ͺ���ΪĿ�꺯�������ݶ��½���������Сֵ���㷨����ѵ�������ij�ʼ�Σ����ֵԶ������ֵ��E��Խϴ� �нϴ���½��ռ䣬���ԣ�E�Լӿ�����������ٶ��нϴ�Ĺ��ף�����ѵ�������Լ�ѵ�������������ӣ����ֵ��������ֵ��E���ϼ�С��

�нϴ���½��ռ䣬���ԣ�E�Լӿ�����������ٶ��нϴ�Ĺ��ף�����ѵ�������Լ�ѵ�������������ӣ����ֵ��������ֵ��E���ϼ�С�� ���½��ռ�Ҳ������С����ʱ������������ٶȽ���÷dz�������ͬʱ������ȫ�־�������E��һ�������Ժ�������ζ����E���ɵ����ӿռ䲻��ֻ��1����С��������棬���Ǵ��ڶ���ֲ���С��ij����棬��ˣ�����洫��������������̺ܿ��ܽ���ֲ���С�㣬��������������ȫ����С�㡣������һȱ�ݵ�ԭ����BPѧϰ��������˰������ݶ��½������������[3, 6-7]��Ϊ�ˣ����Ĺ����˸�������

���½��ռ�Ҳ������С����ʱ������������ٶȽ���÷dz�������ͬʱ������ȫ�־�������E��һ�������Ժ�������ζ����E���ɵ����ӿռ䲻��ֻ��1����С��������棬���Ǵ��ڶ���ֲ���С��ij����棬��ˣ�����洫��������������̺ܿ��ܽ���ֲ���С�㣬��������������ȫ����С�㡣������һȱ�ݵ�ԭ����BPѧϰ��������˰������ݶ��½������������[3, 6-7]��Ϊ�ˣ����Ĺ����˸�������

������

������ �����洫ͳ�㷨�е�ȫ�־�������E(m)����������

�����洫ͳ�㷨�е�ȫ�־�������E(m)���������� �ľ���չ��ʽΪ��

�ľ���չ��ʽΪ��

(10)

(10)

���� ��

��

��Ϊ���仯����

��Ϊ���仯���� Ϊ���仯�ʣ�E(m)�Ƿ��������ڵ�m��ѭ��ѧϰʱ��ȫ�־��� ��

Ϊ���仯�ʣ�E(m)�Ƿ��������ڵ�m��ѭ��ѧϰʱ��ȫ�־��� ��

��ѵ�������ij�ʼ�������ʵ�����������������ϴ� ����ʱ

����ʱ ����Ϊȫ�־������������������ٶȼӿ죻����ѵ�������Լ�ѵ�������������ӣ�E���ϼ�С�����˴�1������0ʱ��

����Ϊȫ�־������������������ٶȼӿ죻����ѵ�������Լ�ѵ�������������ӣ�E���ϼ�С�����˴�1������0ʱ�� ���ֹ���ֵ����ʱ��

���ֹ���ֵ����ʱ�� �����������ٶ�ͬ���ӿ죬����һ���̶��Ͽ˷��˴�ͳBP�㷨�����ٶ�����ȱ�㡣���ں���

�����������ٶ�ͬ���ӿ죬����һ���̶��Ͽ˷��˴�ͳBP�㷨�����ٶ�����ȱ�㡣���ں��� �����ԣ���

�����ԣ��� ʱ������������ʹE(m)��EG(m)ͬʱ�ﵽ��С����������E(m)����������һ�µġ�

ʱ������������ʹE(m)��EG(m)ͬʱ�ﵽ��С����������E(m)����������һ�µġ�

���� ����Ϊ�˲�����ԭ���ǣ���?E(m)��0ʱ��E(m)��E(m-1)��˵��ȫ�־������E(m)�������ֵԶ������ֵ���������仯��?E(m)���E(m)ҪС�ö࣬��ʱ

����Ϊ�˲�����ԭ���ǣ���?E(m)��0ʱ��E(m)��E(m-1)��˵��ȫ�־������E(m)�������ֵԶ������ֵ���������仯��?E(m)���E(m)ҪС�ö࣬��ʱ �ܹ�Ѹ�ټ�С��ʹ�æ�����1����E(m)���ֹ���ֵ�����ܹ��ӿ����������ٶȣ���?E(m)��0ʱ��E(m)��E(m-1)��˵��ȫ�־������E(m)��С�����ֵ��������ֵ����ʱ����Ȼ���仯��?E(m)��С�������仯��

�ܹ�Ѹ�ټ�С��ʹ�æ�����1����E(m)���ֹ���ֵ�����ܹ��ӿ����������ٶȣ���?E(m)��0ʱ��E(m)��E(m-1)��˵��ȫ�־������E(m)��С�����ֵ��������ֵ����ʱ����Ȼ���仯��?E(m)��С�������仯�� ���?E(m)Ҫ��ö࣬��ˣ�

���?E(m)Ҫ��ö࣬��ˣ� �ܹ�Ѹ������ʹ�æ�����0��(1-��)EG(m)���ֹ���ֵ����ͬ��Ҳ�ܼӿ����������ٶȡ�

�ܹ�Ѹ������ʹ�æ�����0��(1-��)EG(m)���ֹ���ֵ����ͬ��Ҳ�ܼӿ����������ٶȡ�

3.3 �ֲ㶯̬���ڲ�ͬѧϰ����

BP�㷨���������ÿ�ε��ڵķ��Ⱦ���1�����������������ȵ�ѧϰ�ʦǽ��С��ڴ�ͳBP�㷨�У��������������㻹��������㣬��������Ȩֵ����ֵ���������������У�ѧϰ�ʦ����ǹ̶�����ġ���ԭ��������E��һ�����ӵķ����Ժ���������ͨ����Сֵ�ķ����õ���Ѳ����ǡ�����������ƽ̹��������Ȩֵ����ֵ�����ĵ��ڷ��Ƚ�С��������Ҫ������ε������ܽ��������潵�ͣ������������϶���������Ȩֵ����ֵ�����ĵ��ڷ��Ƚϴ���������С�㸽����������������ʹ��Ȩֵ��������·�����־���Σ�������������Сֵ�㡣��Ҳ�Ǵ�ͳBP�㷨�����ٶ�����һ����Ҫԭ��[5, 8]��

���IJ���һ�ֲַ㶯̬������ͬѧϰ�ʵ��·��������ֿ����������ѧϰ�ʦ�1��������ѧϰ�ʦ�2���Ӷ�����˴�ͳ�㷨�й̶������ѧϰ�ʦǡ�����Deltaѧϰ����������������������Ȩֵvjt������㵽�����������Ȩֵwij���������ֱ�Ϊ��

(11)

(11)

���� ��

��

(12)

(12)

����

ͬʱ����BP�Ľ��㷨�У���ѧϰ�� ��

�� �ֱ��������������ʽ��

�ֱ��������������ʽ��

, 0��

, 0�� ��1

��1

, 0��

, 0�� ��1 (13)

��1 (13)

ʽ�У� �Ƿ��������ڵ�m+1��ѭ��ѧϰʱ������ѧϰ�ʣ�

�Ƿ��������ڵ�m+1��ѭ��ѧϰʱ������ѧϰ�ʣ� �Ƿ��������ڵ�m+1��ѭ��ѧϰʱ�������ѧϰ�ʣ�

�Ƿ��������ڵ�m+1��ѭ��ѧϰʱ�������ѧϰ�ʣ� Ϊ���������ڵ�m��ѭ��ѧϰʱ�����ھ������仯�ʣ�

Ϊ���������ڵ�m��ѭ��ѧϰʱ�����ھ������仯�ʣ� Ϊ������ȡֵ��ΧΪ0��

Ϊ������ȡֵ��ΧΪ0�� ��1������ͳһȡ

��1������ͳһȡ =0.5��

=0.5��

�������ѧϰ����Ϊ����������ԭ���ǣ��� ��0ʱ��˵��ѧϰ����������ֵԶ������ֵ��Ȩֵ����������Ҫ��С

��0ʱ��˵��ѧϰ����������ֵԶ������ֵ��Ȩֵ����������Ҫ��С ��

�� ����ʽ(11)��ʽ(12)��֪��������ѧϰ��

����ʽ(11)��ʽ(12)��֪��������ѧϰ�� ��

�� ��

�� ��

�� Ҳ��Ȼ��С��ͬʱ��ʽ(13)���Կ�����

Ҳ��Ȼ��С��ͬʱ��ʽ(13)���Կ����� ��

�� ��

�� ��

�� ��

�� ��

�� ��С�����ܼӿ����������ٶȣ���

��С�����ܼӿ����������ٶȣ��� ��0ʱ��˵��ѧϰ����С�����ֵ��������ֵ����Ҫ����

��0ʱ��˵��ѧϰ����С�����ֵ��������ֵ����Ҫ���� ��

�� ������ʱ����Ѿ���С��

������ʱ����Ѿ���С�� �ı仯ҲС�������ٶȺ�������

�ı仯ҲС�������ٶȺ������� ��

�� Ҫ��ö࣬��ˣ���ʽ(13)���Կ�����

Ҫ��ö࣬��ˣ���ʽ(13)���Կ����� ��

�� ��

�� ��

�� ��

�� ��

�� ��������ͬ��Ҳ�ܼӿ����������ٶ�[9]��

��������ͬ��Ҳ�ܼӿ����������ٶ�[9]��

��ˣ�BP�Ľ��㷨�����������������Ԫ������Ȩֵvjt��wij������ʽ�ֱ�Ϊ��

(14)

(14)

(15)

(15)

3.4 BP�Ľ��㷨�ȶ��Է���

ѧϰ�ʵ�ѡ������������������������Ҫ��ѧϰ��̫С��ʹ��������̫����ѧϰ��̫�����ʹ��������в��ȶ���Ϊ�˸�Ч��ѵ�������磬����ɢ�͵�Lyapunov�ȶ��Է�����������BP�Ľ��㷨Ϊ����������֤�������ȶ��Ե�����Ӧѧϰ��[10-11]��

����1���� ���㣺

���㣺

0�� ��

�� ��

��

��������ѧϰ�㷨������Ķ�Ȩֵ �ĵ���ѧϰ�����ȶ�������

�ĵ���ѧϰ�����ȶ�������

����2���� ���㣺

���㣺

0�� ��

�� ��

��

��������ѧϰ�㷨������Ķ�Ȩֵ �ĵ���ѧϰ�����ȶ�������

�ĵ���ѧϰ�����ȶ�������

����֤������1��

����Lyapunov���������봫ͳ�������ƣ������ʽΪ��

(16)

(16)

���ǣ��У�

(17)

(17)

ѧϰ���̵������Ա�ʾΪ��

(18)

(18)

���������㵽���������Ȩֵ ���������ǣ�

���������ǣ�

(19)

(19)

���ǣ��У�

(20)

(20)

����

����� ����1��

����1�� ά��������ע�BP�Ľ��㷨�У�ѡ��Sigmoid������Ϊ�����Ĵ��ݺ�������

ά��������ע�BP�Ľ��㷨�У�ѡ��Sigmoid������Ϊ�����Ĵ��ݺ������� ����0��

����0�� ��1/4�����ԣ�

��1/4�����ԣ�

(21)

(21)

����ŷ�Ϸ����Ķ��壬�У�

(22)

(22)

�Ӷ�����0�� ��

�� ʱ��

ʱ��

�� ��0����ʱ

��0����ʱ ��0��������ɢ��Lyapunov�ȶ���ԭ������

��0��������ɢ��Lyapunov�ȶ���ԭ������ ʱ,

ʱ, ��������0������

��������0������ ʱ,

ʱ, ����ʱ

����ʱ

������0�����Կ�֪ѵ�����

������0�����Կ�֪ѵ����� ���������㣬����1֤�ϡ�

���������㣬����1֤�ϡ�

ͬ������֤������2��

�����������Ľ��ۿ�֪���� ����0��

����0��  ��

�� ʱ���ɱ�֤����ѵ������������

ʱ���ɱ�֤����ѵ������������ ʱ��

ʱ��

�ﵽ��С����������������ٶ���������������Ϊ

����ȡ

����ȡ

�����Ա�֤�����ԽϿ��ٶ�������ͬ������ȡ

�����Ա�֤�����ԽϿ��ٶ�������ͬ������ȡ

���Ա�֤����Ͽ�������

���Ա�֤����Ͽ�������

4 ȱ�ݼ�����鼰����

4.1 �㷨����

������������������BP�Ľ��㷨����ȱ�ݼ�����ľ���ʵ�ֲ������¡�

(1) ��ʼ������Ȩֵ(wij��vjt)����ֵ(��j�ͦ�t)��ѧϰ��(��1�ͦ�2)�ʹ��ݺ�����б�Ȳ��� �����������P��ѵ��������Ϊn�飬ÿ���������ΪPi(1��i��n)���趨���������������Լ����ѭ����������M����

�����������P��ѵ��������Ϊn�飬ÿ���������ΪPi(1��i��n)���趨���������������Լ����ѭ����������M���� ��1��k��PiΪ���ڵ�m�ε���ʱ�����ʵ���������

��1��k��PiΪ���ڵ�m�ε���ʱ�����ʵ��������� ��1��k��PiΪ���������������mΪѭ��������������m=0��

��1��k��PiΪ���������������mΪѭ��������������m=0��

(2) �������������������� ��1��k��Pi��

��1��k��Pi��

(3) ���������� ����ʽ(1)��(3)�ֱ���������������������ֵ����ʽ(2)��(4)�ֱ��������������������ֵ������������Ĵ��ݺ���ѡ����

����ʽ(1)��(3)�ֱ���������������������ֵ����ʽ(2)��(4)�ֱ��������������������ֵ������������Ĵ��ݺ���ѡ���� Ϊ��б�Ȳ�����˫������S�ͺ���

Ϊ��б�Ȳ�����˫������S�ͺ���

�������Ĵ��ݺ���ѡ����Sigmoid�ͺ���

�������Ĵ��ݺ���ѡ����Sigmoid�ͺ��� ��

��

(4) ���������ֵyk����һ����õĸ�����ʵ�����ֵCk(m)������������ľ������ ���жϸ�������Pi��ѵ�������Ƿ�ѧϰ��ϣ����ǣ���ʽ(9)�������ѵ��������ȫ�־���������m=m+1������ת��(2)��

���жϸ�������Pi��ѵ�������Ƿ�ѧϰ��ϣ����ǣ���ʽ(9)�������ѵ��������ȫ�־���������m=m+1������ת��(2)��

(5) �ж�ѭ��ѧϰ����m�Ƿ�������ѭ����������M�����ǣ���ת��(9)�������жϸ���ѵ�������ĵ�m��ѭ��������ȫ�־������|E(m)|�Ƿ�С�����������ţ������ж�����Ȩֵ�ı仯�Ƿ��Ѿ���С����|vjt(m+1)-vjt(m)|���ţ�|wij(m+1)-wij(m)|���ţ����ǣ���ת��(7)������ת��(6)��

(6) �ж�?E����?E��0.001������Ҫ�������ø���������ͬѧϰ�ʦ�1(m)����2(m)�ʹ��ݺ�����б�Ȳ��� �������·���(2)����?E��0.001������ڸ���������������

�������·���(2)����?E��0.001������ڸ��������������� ��1��k��Pi���Ȱ�ʽ(13)����ѧϰ�ʦ�1(m)�ͦ�2(m)�����Ű�ʽ(14)��(15)�ֱ�������������Ԫ������Ȩֵvjt(m)�����������Ԫ������Ȩֵwij(m)��

��1��k��Pi���Ȱ�ʽ(13)����ѧϰ�ʦ�1(m)�ͦ�2(m)�����Ű�ʽ(14)��(15)�ֱ�������������Ԫ������Ȩֵvjt(m)�����������Ԫ������Ȩֵwij(m)��

(7) ����ͬ��ѵ����������ѧϰ��(��1(m)�ͦ�2(m))����������£��ж� �ı�����Ƿ�3�Σ����ǣ���ת��(8)�������ʵ��ı䴫�ݺ�����б��

�ı�����Ƿ�3�Σ����ǣ���ת��(8)�������ʵ��ı䴫�ݺ�����б�� �������·���(2)��

�������·���(2)��

(8) �Ƚ���ͬѧϰ��(��1(m)�ͦ�2(m))�Ͳ�ͬ ����ֵ�����£�����ѵ������ȫ�־������E���ó�ʹ�����������������Сʱ��

����ֵ�����£�����ѵ������ȫ�־������E���ó�ʹ�����������������Сʱ�� ��

��

(9) �㷨������

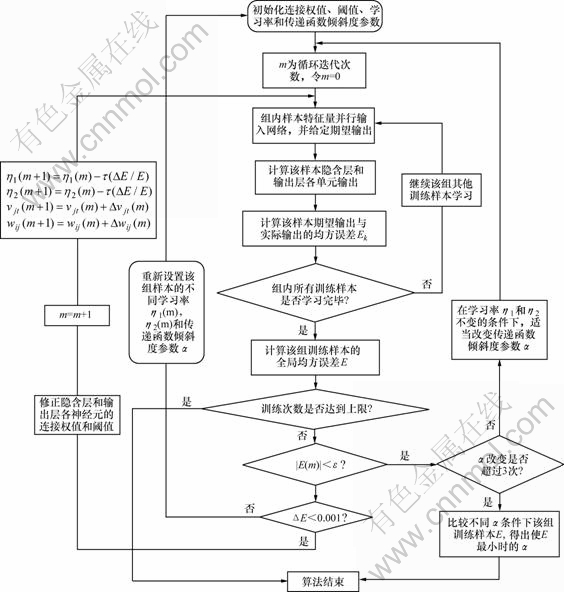

BP�Ľ��㷨������ͼ3��ʾ��

4.2 ѵ������ѡ�����ȡ

������ѡȡ���ֳ�����6�ֱ���ȱ������ͼ��ѵ�����磬����ѹ�ۡ�����ɫ�����ˡ��ɱߡ�����ӡ��ѵ������ͼ��Ļ�ȡ��ʽ���£�רҵ�ʼ���Ա���ֳ��ɼ���������������ͼ���ȱ��ͼ��ͱ�ͼ����м��б궨������ѡ��750�ŵ��͵ġ��ܴ�������ȱ�ݵ�����ͼ����Ϊѵ������ͼ�����о��ֶ��DZ������漰�ij����ļ���ȱ�����ͣ���ȱ��ͼ�������Լ�ȱ�ݲ��ֵķ�λ������ͬ���磺����������ֳ��������ŵ�������ͼ��Ŵ����С������ͬ��ʹ��ȱ�ݲ��������Ȳ�һ�����������������豸��ԭ�����ͬ��ȱ�ݵ�ȱ�ݷ����λ�ò�һ�£�ѵ��ͼ���Ǿ���ˮƽ��ת��ͬ������45�㣬90�㣬135���180���γɵġ�ֵ��������ǣ������������������ֳ������ܸ��ӣ������Ÿ��ָ������ź����������ԣ��ɼ��õ���������������ͼ�������в�ͬ�̶ȵ�ʧ���������Ҫ��ϵͳ����ȡ����ͼ����������֮ǰ�Ƚ���ͼ���Ԥ��������(ȥ�롢�˲�)��������������ϵͳ��죬�Ӷ��ó�����Ľ��ۡ�

4.3 ����������

�������ֱ���ȱ�ݼ��ϵͳ�в�������BP�Ľ��㷨�������Բ���3��ṹ��ⷽʽ��������ͼ�������������ʵʱ����ⷽ��������������ͼ������ȱ�ݵIJ��֣���������ο�����������Ըþ��ο������ڵ��������ص���ҵ����µ��Ͻ���ɨ�裬����������ص�ĻҶȣ�����ȡ�þ��ο�������ͼ���NMI����[12]���ͽײ����(M1��M2��M3��M4)���������ο������������ص�ĻҶ�ƽ��ֵ�ͻҶȷ����ܹ�7����������Ϊȱ��ͼ�������ʸ����������������ʸ����Ϊ��������룬����������15����Ԫ�������ʼȨֵ�ͳ�ʼ��ֵ��Χ��Ϊ-0.5~0.5������������=0.000 5��������������Ϊ2 000��

ͼ3 BP�Ľ��㷨����ͼ

Fig.3 Flow chart of improved BP algorithm

ͬʱ�����ǵ����ֱ����������ʱ���п��ܳ������У���ˣ�ֻ��������������ӦΪ����ȱ �ݡ�(0, 0)�͡���ȱ�ݡ�(1, 1) 2����������ԣ��������Ԫ��ĿΪ2��ϵͳ��ѡ��������Ĵ��ݺ���Ϊ��б�Ȳ��� ��˫������S�ͺ���g(x)�������Ĵ��ݺ���Ϊ������Sigmoid�ͺ���f(x)��Ϊ����ѧϰ�㷨�����������ѧϰ�ٶȣ����������Ϊ��ӦС������(0.000 1, 0.000 1)��Ϊ����ȱ�ݡ���(0.999 9, 0.999 9)��Ϊ����ȱ�ݡ���

��˫������S�ͺ���g(x)�������Ĵ��ݺ���Ϊ������Sigmoid�ͺ���f(x)��Ϊ����ѧϰ�㷨�����������ѧϰ�ٶȣ����������Ϊ��ӦС������(0.000 1, 0.000 1)��Ϊ����ȱ�ݡ���(0.999 9, 0.999 9)��Ϊ����ȱ�ݡ���

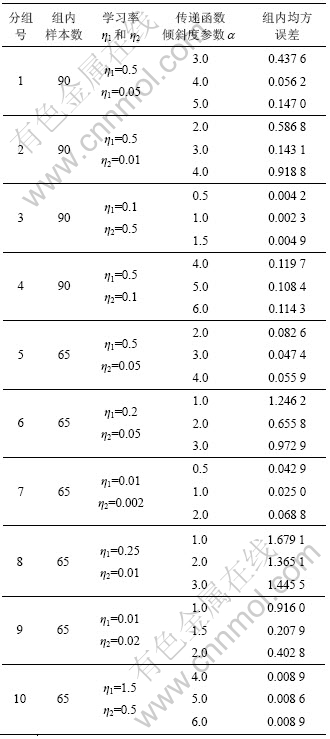

��ȱ�ݼ�������У����Ȱ���ѡ������750��ѵ�������ֳ�10�飬ǰ4��ÿ��������Ϊ90����6��ÿ��������Ϊ65�����ڸ�����������ѧϰ�ʦ�1�ͦ�2һ���������£��Ƚ�3����ͬ��б�Ȳ��� ����Ӧ������ȫ�־����������м�

����Ӧ������ȫ�־����������м� ����Ӧ������ȫ�־��������С������ʵ�������1��ʾ���ӱ�1���Կ��������������϶��ѵ�������飬��ѧϰ�ʦ�1�ͦ�2һ���������£���б�Ȳ���

����Ӧ������ȫ�־��������С������ʵ�������1��ʾ���ӱ�1���Կ��������������϶��ѵ�������飬��ѧϰ�ʦ�1�ͦ�2һ���������£���б�Ȳ��� ��ͬȡֵ����Ӧ������ȫ�־���������ϴ������������ٵ�ѵ�������飬��ѧϰ�ʦ�1�ͦ�2һ���������£���б�Ȳ���

��ͬȡֵ����Ӧ������ȫ�־���������ϴ������������ٵ�ѵ�������飬��ѧϰ�ʦ�1�ͦ�2һ���������£���б�Ȳ��� ��ͬȡֵ����Ӧ������ȫ�־����������С��

��ͬȡֵ����Ӧ������ȫ�־����������С��

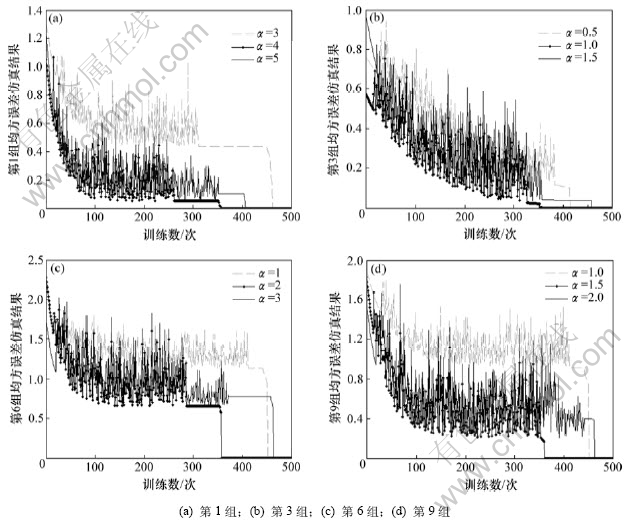

Ϊ�о���б�Ȳ��� ȡ��ֵͬʱ��BP�Ľ��㷨��������Լ��������ھ�������Ӱ�죬�ӱ�1��10��ѵ�������зֱ�ѡȡ��1��3��6��9�����BP����ѵ������ʵ�飬��������ͼ4��ʾ�����У���1��3��ÿ��������Ϊ90����6��9��ÿ��������Ϊ65�����ڸ���ѵ����������ѧϰ�ʦ�1�ͦ�2һ���������£��Ƚ���б�Ȳ���

ȡ��ֵͬʱ��BP�Ľ��㷨��������Լ��������ھ�������Ӱ�죬�ӱ�1��10��ѵ�������зֱ�ѡȡ��1��3��6��9�����BP����ѵ������ʵ�飬��������ͼ4��ʾ�����У���1��3��ÿ��������Ϊ90����6��9��ÿ��������Ϊ65�����ڸ���ѵ����������ѧϰ�ʦ�1�ͦ�2һ���������£��Ƚ���б�Ȳ��� ȡ3����ֵͬʱ����Ӧ�����ھ�������ѵ����������ͼ4���Կ�������

ȡ3����ֵͬʱ����Ӧ�����ھ�������ѵ����������ͼ4���Կ������� ȡ�м�ֵʱ��BP�Ľ��㷨�����ٶ���죬������250~350��֮������������Ҵ�ʱ����Ӧ������ȫ�־�������ܴﵽ��Сֵ����

ȡ�м�ֵʱ��BP�Ľ��㷨�����ٶ���죬������250~350��֮������������Ҵ�ʱ����Ӧ������ȫ�־�������ܴﵽ��Сֵ���� ȡ�м�ֵ�ĵ㻮������λ�ڷ���ͼ���·�����ˣ�����ͼ4ѵ�������;�����ͬ����ȷ��ÿ��ѵ��������

ȡ�м�ֵ�ĵ㻮������λ�ڷ���ͼ���·�����ˣ�����ͼ4ѵ�������;�����ͬ����ȷ��ÿ��ѵ�������� �����ֵ����ͼ4�����Կ��������������϶�ĵ�1��3��ѵ����������ѧϰ�ʦ�1�ͦ�2һ���������£�

�����ֵ����ͼ4�����Կ��������������϶�ĵ�1��3��ѵ����������ѧϰ�ʦ�1�ͦ�2һ���������£� ��ͬȡֵ����Ӧ�����ھ���������ϴ������������ٵĵ�6��9��ѵ����������ѧϰ�ʦ�1�ͦ�2һ���������£�

��ͬȡֵ����Ӧ�����ھ���������ϴ������������ٵĵ�6��9��ѵ����������ѧϰ�ʦ�1�ͦ�2һ���������£� ��ͬȡֵ����Ӧ�����ھ����������С��

��ͬȡֵ����Ӧ�����ھ����������С��

��1 BP�Ľ��㷨����ѵ��ʵ����

Table 1 Improved BP algorithm group training results

4.4 �㷨���ܱȽ�

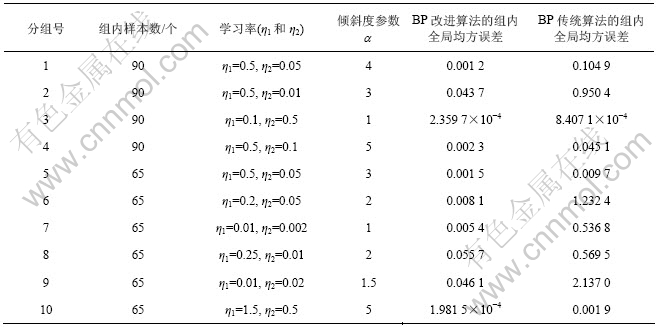

Ϊ�˱��ڷ���Ƚϴ�ͳ�㷨�Ľ��㷨�����ܣ����ֳ��ɼ�����������ȱ��ͼ����ͬ��ѡȡ750������������������ȫ�־������ļ��㡣���ǵ��ֳ��ɼ�������ӣ���750�����������������1�з���ѵ�������ѧϰ�����нϴ��ظ����ڼ���BP�Ľ��㷨������ȫ�־������ʱ�����Բ��ñ�1�и��������Ѳ���ֵ������������ʵ�������2��ʾ��

ͼ4 BP�Ľ��㷨��������ѵ��������

Fig.4 Simulation results for improved BP algorithm group training

��2 BP��ͳ�㷨��BP�Ľ��㷨�������ʵ����

Table 2 Experimental results comparison between traditional and improved BP algorithm

�ӱ�2���Կ�����������BP�Ľ��㷨������ȫ�־�����������С��BP��ͳ�㷨������ȫ�־���������������750������������BP�Ľ��㷨������ȫ�־������Ϊ0.016 81��BP��ͳ�㷨������ȫ�־������0.558 90��BP�Ľ��㷨��ȫ�־������ֻ�д�ͳ�㷨��1/30���øĽ��㷨ͨ��������ݺ�����б���Լ���̬���ڲ�ͬѧϰ���ʣ��ܺõؿ˷��˴�ͳBP�����翹���������ѧϰ�ٶ�����������ֲ���С���ȱ�㣬ʹ�ô�ͳBP�㷨���ܽ�һ����ߡ�

5 ����

(1) ͨ��������ͳBP�㷨��ȱ�㼰����Ľ�������ѵ����ʽ�����ݺ������������µĸ���������ͬʱ������һ�ֲַ㶯̬������ͬѧϰ�ʵ��·������õ�һ���µ�BP�Ľ��㷨��������Lyapunov�ȶ��Է����Ը��㷨�������Խ����˷�����

(2) �Ľ��㷨�������ٶȺͱ���ֲ���С�����������ڴ�ͳBP�㷨���ܺõؿ˷��˴�ͳBP�����翹���������ѧϰ�ٶ�����������ֲ���С���ȱ�㣬ʹ��BP�㷨���ܽ�һ����ߣ���һ��ѵ��BP�������Ч������

�����

[1] �ź���, ������, ������, ��. �ְ��������л���ģ��������IJ���ʶ��[J]. ��������������, 2003, 11(1): 14-17.

ZHANG Hai-dong, LAI Kang-sheng, DAI Dong-ming, et al. Application of fuzzy neural network on parameter recognition of steel strip��s nondestructive testing[J]. Computer Automated Measurement & Control, 2003, 11(1): 14-17.

[2] ��Խ, �ܳ���. BP����ֲ���С������ԭ�����������[J]. ���������, 2002, 28(6): 35-37.

WANG Yue, CAO Chang-xiu. Analysis of local minimization for BP algorithm and its avoidance methods[J]. Computer Engineering, 2002, 28(6): 35-37.

[3] �±�, ����, ������, ��. �������֤�������ںϵĹܵ�й©��Ϸ���[J]. �����ʵ��ѧѧ��, 2009, 32(1): 9-13.

CHEN Bin, WAN Jiang-wen, WU Yin-feng, et al. A pipeline leakage diagnosis for fusing neural network and evidence theory[J]. Journal of Beijing University of Posts and Telecommunications, 2009, 32(1): 9-13.

[4] �ܻ���, ֣ا��, ţ��, ��. ���ڵݽ��Ŵ��㷨��BP�����ģʽ�����[J]. ϵͳ����ѧ��, 2009, 29(8): 2243-2247.

ZHOU Hui-ren, ZHENG Pi-e, NIU Ben, et al. HGA-BP-based pattern classification method[J]. Journal of System Simulation, 2009, 29(8): 2243-2247.

[5] Kamarthi S V, Pittner S. Accelerating neural network training using weight extrapolations[J]. Neural Networks, 1999, 12(9): 1285-1299.

[6] Martin F, Moller S. A scaled conjugate gradient algorithm for fast supervised learning[J]. Neural Networks, 1993, 6(3): 525-533.

[7] Yu C C, Liu B D. A backpropagation algorithm with adaptive learning rate and momentum coefficient[C]//Proceedings of the 2002 International Joint Conference on Neural Networks (IJCNN��02). Honolulu, 2002: 1218-1223.

[8] WANG Wei, YU Bo.Text categorization based on combination of modified back propagation neural network and latent semantic analysis[J]. Neural Computing and Applications, 2009, 18(8): 875-881.

[9] WU Wei, SHAO Hong-mei, QU Di. Strong convergence for gradient methods for BP networks training[C]//ZHAO Ming-sheng, SHI Zhong-zhi. Proceedings of 2005 International Conference on Neural Networks and Brains. Beijing: IEEE Press, 2005: 332-334.

[10] MAN Zhi-hong, WU Hong-ren, LIU S, et al. A new adaptive backpropagation algorithm based on Lyapunov stability theory for neural networks[J]. IEEE Trans on Neural Networks, 2006, 17(6): 1580-1591.

[11] Wong W K, Yuan C W M, Fan D D. Stitching defect detection and classification using wavelet transform and BP neural network[J]. Expert Systems with Applications, 2009, 36: 3845-3856.

[12] ����, ��¼ƽ, �����, ��. ������������������ͼ��NMI������ȡ����������[J]. �Զ���ѧ��, 2010, 7(4): 931-938.

LIU Qing, XU Lu-ping, MA Yi-de, et al. Image NMI feature extraction and retrieval method based on pulse coupled neural networks[J]. Acta Automatica Sinica, 2010, 7(4): 931-938.

(�༭ ����ƽ)

�ո����ڣ�2010-02-06�������ڣ�2010-07-10

������Ŀ�����ҿƼ��ش�ר��(2009ZX03004-001)

ͨ�����ߣ��Ź��(1982-)���У����ϳ�ɳ�ˣ���ʿ�о������������߷������硢��֪�������硢�ƶ�������������Ӧ�ú�ģʽʶ���о����绰��13426083917��E-mail: zgysam@gmail.com