DOI�� 10.11817/j.issn.1672-7207.2020.02.012

���ڶ��Gabor����ͼЭͬ��ʾ��³������ʶ��

����1, 2,������1, 2, 3,�����1, 2,����Ե1, 2

��1. �人�Ƽ���ѧ ��Ϣ��ѧ�빤��ѧԺ������ �人��430081��

2. �人�Ƽ���ѧ ������������ϵͳ�о�Ժ������ �人��430081��

3. �人�Ƽ���ѧ ������ұ���Զ������⼼�������о����ģ����� �人��430081��

ժҪ:Ϊ�����ϡ���ʾ����(SRC)�㷨�ڿɱ���ա���̬�ͱ����µ�����ʶ�����ܣ����һ�ֻ��ڶ��Gabor����ͼ(MGFM)��Эͬ��ʾ����(CRC)��³������ʶ�������ȣ�������ͼ����ж���߶�Gabor�任�����ں�ͬһ����ͬ�߶ȵ�Gabor����;��Σ���ÿ��������ں�����ͼ����ȡGist�������ڽ�������ʶ��ʱ���ɲ�ȡ2�ַ���:1) ������ͼ�����з����Gist����ֱ�Ӵ���������Ӧ��Ȩ������������ȫ����������,��ʹ��Эͬ��ʾ�������õ�ʶ����;2) ������ͼ��ÿ�������Gist���������ֱ�ʹ��Эͬ��ʾ����������Ԥ���࣬Ԥ����ʱʹ������ӦK���ڲ���ȷ����ѡ�ಢ�������֣�ȡ�ܵ÷���ߵ�����Ϊʶ�����������ORL��Extended Yale B��AR���������ݿ��Ͽ�չ����ʶ��ʵ�飬������ķ����ֱ�ȡ��99.8%��100%��99.7%��ʶ��ȷ�ʺͽϿ��ִ���ٶȡ��о�������������ķ������ö��Gabor����ͼ(MGFM)��������ͼ���������ʾ����Ч���������ֲ���Ϣ����������ӦK���ڲ��ԸĽ�Эͬ��ʾ�����㷨��ȡ�ýϸߵ�ʶ��ȷ�ʺ�ִ��Ч�ʡ�

�ؼ���:����ʶ��Эͬ��ʾ�����Gabor����ͼ������ӦK����

��ͼ�����:TP391.41 ���ױ�־��:A ���ſ�ѧ(��Դ����)��ʶ��(OSID)

���±��:1672-7207��2020��02-0377-08

Robust face recognition based on collaborative representation of multi-directional Gabor feature maps

ZHANG��Pei1, 2, XU��Wangming1, 2, 3, WU��Shiqian1, 2, JIN��Xiaoyuan1, 2

(1. School of Information Science and Engineering, Wuhan University of Science and Technology,Wuhan 430081, China��

2. Institute of Robotics and Intelligent Systems, Wuhan University of Science and Technology,Wuhan 430081, China��

3. Engineering Research Center for Metallurgical Automation and Detecting Technology of Ministry of Education, Wuhan University of Science and Technology, Wuhan 430081, China)

Abstract: To improve the performance of face recognition based on SRC under conditions with varied illumination, pose and expression, a robust face recognition method based on multi-directional Gabor feature maps (MGFM) and collaborative representation classification(CRC) was proposed. Firstly, the multi-directional and multi-scale Gabor transform were performed on the face image, and the obtained Gabor features with different scales in the same direction were fused. Secondly, the Gist features were extracted for the fused feature maps in each direction. There were two ways which could be adopted to implement face recognition: 1) the Gist features of all directional feature maps of a face image were cascaded without or with adaptively-weighting to form the global feature vector of the face image and the recognition result was obtained based on collaborative representation classifier; 2) the pre-classification results were obtained by combining Gist features in each direction of a face image with collaborative representation classifiers respectively. The scores of the candidate classes were determined using the adaptive K nearest neighbor strategy, and the final recognition result had the highest total score Thirdly, experiments of face recognition were carried out on ORL, Extended Yale B and AR face database, and the proposed method reached the recognition accuracy of 99.8%, 100% and 99.7% respectively and obtained a faster execution speed. The results show that the proposed method can effectively describe the local information of face image using the multi-directional Gabor feature maps(MGFM), and the improved collaborative representation classification algorithm with the adaptive k-nearest neighbor strategy ultimately achieves higher recognition accuracy and execution efficiency.

Key words: face recognition; collaborative representation; multi-directional Gabor feature maps; adaptive K nearest neighbor

��Ϊ������ʾ�ĵ��ͷ�ʽ֮һ��ϡ���ʾ(sparse representation��SR)���㷺Ӧ���ڼ�����Ӿ���ģʽʶ��ͻ���ѧϰ������[1]��WRIGHT��[2]��ϡ���ʾ������������ʶ���������ϡ���ʾ����(sparse representation-based classification, SRC)������ʶ�����÷�����Eigenfaces[3]��Fisherfaces[4]�ȴ�ͳ������ȣ���Ч�������˶Թ��ա���̬�������Լ��ڵ��ȿɱ����ص�³���ԣ�Ϊ����ʶ�������о��ṩ����˼·��GAO��[5]����˻��ں�ϡ���ʾ����(kernel SRC��KSRC)������ʶ����ͨ����ӳ���ϵ��ȡ�����ķ��������ԣ���������������������˱���ϵ��������ϡ���ԡ�YANG��[6]���������Ȼ���ƽ��ϡ��������⣬�����һ��³����ϡ�����ģ�ͣ�����˶Կɱ����ص���Ӧ�ԡ���Щ�㷨������SRC�������������ϵ�������Ч�ʣ��ǻ�������ͼ�����ػҶȵ�ȫ�����У����ǶԹ��ա���̬�ͱ����Ӱ�����صı�������Ȼ���������ǵ�Gabor�����ܹ���������ͼ���ڲ�ͬ����ͳ߶ȵľֲ�������Ϣ[7]��YANG��[8]����˻���Gabor����ϡ���ʾ����(Gabor-feature based SRC, GSRC)������ʶ����ͨ��Gabor��������Ĺ��걸�ֵ���߱���ϵ��������ϡ��ȣ����������ʶ��ȷ�ʡ���������[9]�����һ�ֻ��ڶ��Gabor����ͼϡ���ʾ(multi-directional Gabor feature maps based SRC��MGFM-SRC)������ʶ������MGFMͼ������ȡ�����ļ�ȨGist���������SRC�㷨����ʶ�𣬽�һ�����������ʶ�����ܡ�����ɽ��[10]����Gabor��ͨ��ģ�ͣ���ȡ��ͬͨ����Gabor�����ֱ����ֵ���ϡ���ʾ�������������һ�ֻ���Gabor��ͨ����Ȩϡ���ʾ�����㷨(weighted multi-channel Gabor sparse representation classification��WMC-GSRC)��������Щ����SRC�ķ�����Ҫ���L1-������С��Լ�����⣬һ���õ�������⣬���㸴�ӣ���ZHANG��[11]����ϡ���Բ�����ȡ�ýϺ�����ʶ��Ч���ı������أ�����˻���Эͬ��ʾ���������ʶ��(collaborative representation-based classification, CRC)�����Ż�Ŀ�꺯������L2-�������L1-�������ϵ����������һ�����������ʶ���Ч�ʺ�ȷ�ʡ����������������о������ϣ����һ�ָ���Ч�Ļ��ڶ��Gabor����ͼЭͬ��ʾ(MGFM based CRC��MGFM-CRC)��³������ʶ�������ȣ�������ͼ�������߶�Gabor�˲���������õ���ͬ����ͬ�߶ȵ�Gabor������Ȼ��ͬһ����ͬ�߶ȵ�Gabor���������ںϣ�����ÿ��������ں�����ͼ����ȡGist������������ʶ��Σ����IJ���2��ʶ����ԣ�1) �����з����Gist����ֱ�Ӵ���������Ӧ��Ȩ����������������������ʹ��Эͬ��ʾ�������õ�ʶ������2) ��ÿ�������Gist���������ֱ�ʹ��Эͬ��ʾ����������Ԥ���࣬Ԥ����ʱʹ������ӦK���ڲ���ȷ����ѡ�ಢ���֣�ȡ�ܷ���ߵ�����Ϊʶ����������ڵ����������ݿ�ORL��Extended Yale B��AR��ͨ��ʵ����֤���ķ������ڹ��ա���̬�ͱ���ȿɱ����ص���Ӧ�ԡ�

1 ���Gabor����ͼ����Gist������ʾ

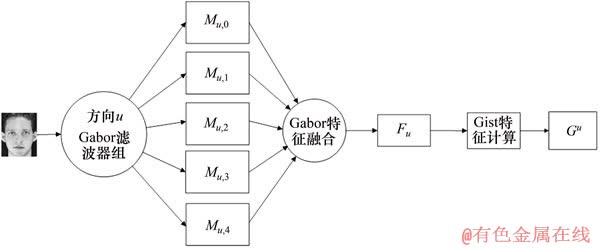

�������������ͼ�����ȣ���������Gabor����ͼ(MGFM)������һ����ȡGist����������������������������ͼ����Ϣ��ͼ1��ʾΪGabor����ͼ����Gist������ȡ���̡�������1������Ϊ�������ȣ�������ͼ����÷����һ�鲻ͬ�߶ȵ�Gabor�˲������о������õ��÷���ͬ�߶��µ�Gabor����ͼ��Ȼ���ں϶���߶ȵ�ʵ�����鲿Gabor����������ںϺ��ֵ����ͼ��һ����ȡGist�������õ���������ͼ���ڸ÷����µ�1���������������������ͬ�����µ�������ȡ�����Դ����ơ�

�÷������ص����ڣ�1) ���������ںϷ�����СGabor������������Ϣ�����̶ȵر������õľֲ��������ԣ�2) ����Gist������ȡ�ںϺ�ķ�ֵ����ͼ��ȫ��������ʾ����Gabor�ֲ������ڱ�ʾͼ����Ϣ���γɻ�����������������ͼ���������и��߷ֱ��ʡ�����������ȡ���̵���Ҫ����ɷ�Ϊ��Gabor�ֲ�������ȡ����߶�Gabor�����ںϺ�Gist�������㡣

ͼ1����u�������ϵ�Gabor����ͼ����Gist������ȡ

Fig. 1��Gabor feature map and its Gist feature extraction in the u-th direction

1.1��Gabor�ֲ�������ȡ

��άGabor�˲����˺��� [12]����Ϊ

[12]����Ϊ

(1)

(1)

ʽ�У� ��

�� �ֱ�ΪGabor�˺����ķ���ͳ߶ȣ�

�ֱ�ΪGabor�˺����ķ���ͳ߶ȣ� Ϊ2-�����������

Ϊ2-����������� Ϊͼ���������ꣻ

Ϊͼ���������ꣻ  ��

�� ��

�� ��Gabor�˺����Ǹ�����ʽ������ʵ�����鲿2��������ʵ���˲�������ƽ��ͼ���Ч�����ɼ��ٶԹ��յ����жȣ��鲿�˲�������Ч����ͼ��ı�Ե��Ϣ�����IJ���8������

��Gabor�˺����Ǹ�����ʽ������ʵ�����鲿2��������ʵ���˲�������ƽ��ͼ���Ч�����ɼ��ٶԹ��յ����жȣ��鲿�˲�������Ч����ͼ��ı�Ե��Ϣ�����IJ���8������ ��5���߶�

��5���߶� ��Gabor�˲����������ͼ����о�����

��Gabor�˲����������ͼ����о�����

(2)

(2)

ʽ�У�I(z)Ϊ����ͼ��Mu,v(z)Ϊ����u�߶�v�µ�Gabor������ Ϊ�����������

�����������

1.2����߶�Gabor�����ں�

����Gabor�任�õ��IJ�ͬ����ͳ߶ȵ�Gabor�������������ԣ�����һ���̶ȵ���Ϣ���ࡣAMIN��[13]�����2��Gabor�����ں�˼·�����ں�ͬһ�߶��²�ͬ�����Gabor���������ں�ͬһ�����²�ͬ�߶ȵ�Gabor��������ʵ�����������߱�ǰ�ߵõ���Gabor�ں��������ܹ���������ͼ����Ϣ����������[9]�ڴ˻����������һ�ָĽ��������ںϷ����������������������ںϷ��������巽���������£�

1) ����Gabor����ʵ�����鲿�IJ��ö����Ʊ��뷽ʽ�õ���Ӧ�Ķ�ֵ����ͼ��

(3)

(3)

(4)

(4)

ʽ�У� ��

�� �ֱ�ΪGaborʵ���������鲿������

�ֱ�ΪGaborʵ���������鲿������ ��

�� �ֱ�Ϊ�����ͬ����ͳ߶ȵ�ʵ�����鲿��ֵ������

�ֱ�Ϊ�����ͬ����ͳ߶ȵ�ʵ�����鲿��ֵ������

2) �ֱ��ͬһ����(���u������)�²�ͬ�߶ȵ�����ͼ���м�Ȩ�ںϣ��õ�ʮ���Ʊ�����ʽ��

(5)

(5)

(6)

(6)

ʽ�У� ��

�� �ֱ�Ϊ��u�������²�ͬ�߶�ʵ�����鲿�����ںϽ����

�ֱ�Ϊ��u�������²�ͬ�߶�ʵ�����鲿�����ںϽ����

3) ���ݸ����������ںϺ��ʵ���������鲿������÷�ֵ���� ��

��

(7)

(7)

1.3��Gist��������

�ںϺ��ÿ����ֵ����ͼ��Ϊ����ͼ��һ����ȡ�� Gist ����[14]�γɱ�ʾ����ͼ���ȫ��������������������ʶ�𡣼�������ͼ���Gist����ʱ��Ҳ����һ��Gabor�˲���������о���������֮���˲����ͼ��Ϊ���Ȳ��ص��� ��ͼ���ӿ飬����ÿ��ͼ���ӿ�ȡ�Ҷ�ƽ��ֵ��������ͼ���ӿ�ĻҶ�ƽ��ֵ�����������γɱ�ʾͼ�������������

��ͼ���ӿ飬����ÿ��ͼ���ӿ�ȡ�Ҷ�ƽ��ֵ��������ͼ���ӿ�ĻҶ�ƽ��ֵ�����������γɱ�ʾͼ�������������

�Ե� ������Ϊ����������ͼ

������Ϊ����������ͼ ��Ϊ����ͼ����ȡ��Gist�����IJ������¡�

��Ϊ����ͼ����ȡ��Gist�����IJ������¡�

1) ������ͼ ��

�� ��Gabor�˲������о����������õ������������ͼ��

��Gabor�˲������о����������õ������������ͼ��

(8)

(8)

ʽ�У� Ϊ���ص����ꣻ

Ϊ���ص����ꣻ Ϊ��i��Gabor�˲�����

Ϊ��i��Gabor�˲����� Ϊ8������4���߶ȵ�Gabor�˲���������

Ϊ8������4���߶ȵ�Gabor�˲���������

2) �� ���ֳɾ��Ȳ��ص���

���ֳɾ��Ȳ��ص��� ��ͼ���ӿ�

��ͼ���ӿ� ������

������ ��

��

3) ��ÿ��ͼ���ӿ� ȡ�Ҷ�ƽ��ֵ�õ�1������ֵ

ȡ�Ҷ�ƽ��ֵ�õ�1������ֵ ���ٽ���������ͼ�������ӿ������ֵ���������γɱ�ʾÿ������ͼ�����������

���ٽ���������ͼ�������ӿ������ֵ���������γɱ�ʾÿ������ͼ����������� :

:

(9)

(9)

ͨ������������ȡ����õ��� ������Gabor����ͼ

������Gabor����ͼ ��ȫ��������ʾ��ʽ

��ȫ��������ʾ��ʽ ���Դ����ƣ����Եõ����з���Gabor����ͼ��ȫ������������

���Դ����ƣ����Եõ����з���Gabor����ͼ��ȫ������������

2 �������������ʶ��

�������[9]�з�����һ���Ľ������һ�ֻ��ڶ��Gabor����ͼЭͬ��ʾ(MGFM based CRC��MGFM-CRC)������ʶ�����ڵõ���������·�ֵ����ͼ��Gist��������֮��������ʶ��ʱ���ɽ����з����Gist��������(MGFM-CRC-1)������[9]����Ӧ��Ȩ����(MGFM-CRC-2)������������������ʹ��Эͬ��ʾ�������õ�ʶ�����������Ƚ�����2�ַ�������������ڵ����⣬�Ӷ����һ���·��������ȣ���ÿ�������Gist���������ֱ�ʹ����Ӧ��Эͬ��ʾ����������Ԥ���࣬Ԥ����ʱʹ������ӦK���ڲ���ȷ����ѡ�ಢ�������֣�Ȼ�����к�ѡ�������з�������ֽ��л��ܣ����ȡ�ܷ���ߵ�����Ϊʶ�������÷�����ΪMGFM-CRC-3��

2.1��MGFM-CRC-1��MGFM-CRC-2

������ʹ��SRC���������㷨һ��������[9]�����MGFM-SRC����ʶ����������L1-�������ϡ��ϵ�����������㸴�ӡ�Ϊ�˼���SRC�㷨���Ӷȣ�����[11]���CRC�㷨������L2-�������L1-�������ϵ����������ȡ�ý����⣬�ʼ������Ч��CRC�㷨����ǿ���ֽ��ϵ��������ϡ���ԣ����ǿ��ǵ����������ֵ�ԭ�ӵ�Эͬ���ã����ڱ�����SRC�㷨ʶ���ʽӽ�������£����ؼ������ϵ����ʱ�䡣��ˣ������ö��Gabor����ͼ�������Эͬ��ʾ������(CRC)�������ʶ�������巽��������Ϊ������k������n������ͼ����ɵ�ѵ�������������������õ�ÿ��ͼ���ڶ�������ϵ�Gist���������������ǰ�����(MGFM-CRC-1)������[9]����Ӧ��Ȩ����(MGFM-CRC-2)��Ϊ����ÿ������ͼ���ȫ����������������������ȫ�������������ѵ��������������B=[B1,B2, ,Bk]=[

,Bk]=[ ]

] ������

�����У� Ϊ��i��ĵ�j��ѵ������ͼ������������

Ϊ��i��ĵ�j��ѵ������ͼ������������ ��cΪ����������ά�ȡ�������������ά�Ƚϸߣ��������ɷַ�����(principal component analysis��PCA)����1���任����

��cΪ����������ά�ȡ�������������ά�Ƚϸߣ��������ɷַ�����(principal component analysis��PCA)����1���任���� ������ά������ά�õ�����

������ά������ά�õ����� ��ΪЭͬ��ʾ�ֵ�������У�

��ΪЭͬ��ʾ�ֵ�������У� Ϊ���ɷָ�������ά��������ά�ȡ�ͬ���أ�����1����������ͼ�õ��������Ĵ�����������

Ϊ���ɷָ�������ά��������ά�ȡ�ͬ���أ�����1����������ͼ�õ��������Ĵ����������� ������ά���

������ά��� ������Эͬ��ʾϵ������

������Эͬ��ʾϵ������ ��ͨ�������Ż�������⣺

��ͨ�������Ż�������⣺

(10)

(10)

ʽ�У� Ϊ��������

��������

���ڲ���L2-������Ϊ�����ʽ(10)����ʹ�õ�������⣬�������Ϊ�� ����

���� ��һ���ֵ����

��һ���ֵ���� �Ͳ���

�Ͳ��� ��������P�Ϳ���Ԥ�ȼ��������

��������P�Ϳ���Ԥ�ȼ��������

���Эͬ��ʾ��ϵ������ �Ϳ����ø�������ѵ�������ֱ��ع�������������Ӧ���ع����ri(Q)Ϊ

�Ϳ����ø�������ѵ�������ֱ��ع�������������Ӧ���ع����ri(Q)Ϊ

(11)

(11)

ʽ�У� Ϊ

Ϊ �ж�Ӧ��i��ϵ��������

�ж�Ӧ��i��ϵ��������

������ع������С������з��࣬������С�������Ӧ������ǩ��Ϊ����������ʶ������

(12)

(12)

2.2��MGFM-CRC-3

MGFM-CRC-1��MGFM-CRC-2�����������������ͼ�������������ǽ���������Gist�����������Ľ���������γɵ���������ά�Ƚϸߣ����㸴�����ڴ���һ���̶��ϵ�������Ϣ���ࣻͬʱ����2�ַ���������ֻ�Ǹ����ع������С�����ж�ʶ����������С���ʹ�С���ȽϽӽ�ʱ�����ܵ������С�

��ˣ����Ľ�һ�����MGFM-CRC-3����������иĽ������ȣ���ȡ����m�������µ�Gabor����ͼ��Gist�����ֱ���ÿ��������Gabor����ͼ��Gist������Ϊ��������ͼ���������������Σ�����m��Эͬ��ʾ���࣬����ÿ�η������õ�Ԥ��������K���ڲ���ȷ�������֣���һ���������(����С�ع�����Ӧ����)�������m��Эͬ��ʾԤ��������ȡ�ܷ���ߵĺ�ѡ����Ϊ����ʶ�������Է��� Ϊ������˵����

Ϊ������˵����

����k������n��ѵ������ͼ��ǰ��������ȡ�����õ�ÿ��ͼ���ڸ÷����ϵ��������� ��

�� Ϊ��i���j������ͼ�������ڵ�u�������ϵ���������������qΪ����������ά�ȣ�������Щ����������ϳ�������

Ϊ��i���j������ͼ�������ڵ�u�������ϵ���������������qΪ����������ά�ȣ�������Щ����������ϳ������� ��ͬ�����Բ�������ͼ����ȡ�÷����ϵ���������

��ͬ�����Բ�������ͼ����ȡ�÷����ϵ��������� ������

������ �ڶ�Ӧ������

�ڶ�Ӧ������ �ϵ�Эͬ��ʾϵ������

�ϵ�Эͬ��ʾϵ������ ��

��

(13)

(13)

�ټ���÷����ϸ�������Ӧ���ع���� ��

��

(14)

(14)

ʽ�У� ��Ϊ����ͼ�����

��Ϊ����ͼ����� Ϊ�ڵ�u��������õ�ϵ������

Ϊ�ڵ�u��������õ�ϵ������ �����i��ѵ������ͼ��������Ӧ��ϵ��������

�����i��ѵ������ͼ��������Ӧ��ϵ�������� Ϊ�ڵ�u�������i��ѵ������ͼ����������Ӧ��ϵ���Բ�������ͼ���������ع������

Ϊ�ڵ�u�������i��ѵ������ͼ����������Ӧ��ϵ���Բ�������ͼ���������ع������

����ʽ(14)��ʾ��Эͬ��ʾ�ع���� ���з���ʱ��ͨ��������������ж��ع������Сʱ����Ӧ����Ϊ���������ķ�����������û�п�����С����С�������������Ĺ�ϵ�������·�����������ʹ������ӦK���ڲ��Խ��иĽ��������ݸ������Ӧ���ع������趨����ֵ�����Զ�ѡȡK����������Ӧ������Ϊ��ѡ��������Ȼ���ع������������ѡ��������֣��ع����С�ĸ����ķ�ֵ���ع�����ĸ���С�ķ�ֵ�������ڷǺ�ѡ�ֱ࣬�ӽ����ֵ����Ϊ0������ÿ�����i��

���з���ʱ��ͨ��������������ж��ع������Сʱ����Ӧ����Ϊ���������ķ�����������û�п�����С����С�������������Ĺ�ϵ�������·�����������ʹ������ӦK���ڲ��Խ��иĽ��������ݸ������Ӧ���ع������趨����ֵ�����Զ�ѡȡK����������Ӧ������Ϊ��ѡ��������Ȼ���ع������������ѡ��������֣��ع����С�ĸ����ķ�ֵ���ع�����ĸ���С�ķ�ֵ�������ڷǺ�ѡ�ֱ࣬�ӽ����ֵ����Ϊ0������ÿ�����i�� Ϊ�ع�����С�����������������

Ϊ�ع�����С����������������� ��

�� ��ʾ�ع����

��ʾ�ع���� �����j��λ�á�����

�����j��λ�á����� ����ж���������Ӧ��ѡȡK��������

����ж���������Ӧ��ѡȡK��������

(15)

(15)

ʽ�У� Ϊ��������ͼ�����ڵ�u�������µ��������з���ʱ�ж������ڵ�i��ĵ÷֡�

Ϊ��������ͼ�����ڵ�u�������µ��������з���ʱ�ж������ڵ�i��ĵ÷֡�

��ÿ�����������1��Ԥ���࣬һ��m�Σ��õ���Ӧ�ĺ�ѡ�࣬��������ͼ����ÿ������������������з������ںϣ���ÿ����������з�����ܵ÷� Ϊ

Ϊ

(16)

(16)

����������������Ӧ������жϲ�������ͼ���ʶ������

(17)

(17)

���ϣ�����ʶ��MGFM-CRC-3���岽��Ϊ��

1) �Ժ���k������ѵ������ͼ���ñ���ǰ��������ȡ������m(m=8)������ֱ���ȡ��������

��������ÿ�������������

��������ÿ������������� ����һ����PCA��ά�㷨�õ��任����

����һ����PCA��ά�㷨�õ��任���� ���Ӷ��õ�ÿ�������Эͬ��ʾ�ֵ����

���Ӷ��õ�ÿ�������Эͬ��ʾ�ֵ���� ��

��

2) �Բ�������ͼ�Ե�u��������������� �����������ռ�任���õ�ÿ������ά�����������

�����������ռ�任���õ�ÿ������ά����������� ��

��

3) ���ֵ���� �Ͳ���������������

�Ͳ��������������� �ֱ����ʽ(13)�е�

�ֱ����ʽ(13)�е� ��

�� �����Эͬ��ʾ��ϵ������

�����Эͬ��ʾ��ϵ������ ��

��

4) ����ʽ(14)����ÿ�������ÿ�������ع���

��

��

5) ����ʽ(15)��ʽ(16)�õ������з�����ÿ������������ ��

��

6) ����ʽ(17)������������ʱ����Ӧ�������Dz�������ͼ���ʶ������

3 ʵ���������

Ϊ����֤���ķ�������Ч�ԣ�ͨ����CRC�㷨[11]��MGFM-SRC�㷨[9]��MGFM-CRC-1�㷨��MGFM-CRC-2�㷨��MGFM-CRC-3�㷨�ֱ��ڵ����������ݿ� ORL[15]��Extended Yale B[16-17] ��AR[18]�Ͻ���ʵ�顣���У������������£�����ӦK����ϵ�� ȡ5����ORL����L2����ϵ��

ȡ5����ORL����L2����ϵ�� ȡ0.08����Extended Yale B��AR����L2����ϵ��

ȡ0.08����Extended Yale B��AR����L2����ϵ�� ȡ0.001��ʵ������ƽ̨����ΪInter Core(TM)i5����Ƶ3.2 GHz���ڴ�4 G��Matlab R2016b��

ȡ0.001��ʵ������ƽ̨����ΪInter Core(TM)i5����Ƶ3.2 GHz���ڴ�4 G��Matlab R2016b��

3.1���㷨ʶ����

3.1.1��ORL�������ݿ⡡

ORL�������ݿ����40���ˣ�ÿ��10������400������ͼ���ڲ�ͬ�̶ȵĹ��ա��������̬�仯������ʵ���н�ԭʼͼ�����ع�һ��Ϊ ��ͨ��ORL�������ݿ����Ƚϸ����㷨�ڲ�ͬѵ�����������µı��֡���1��ʾΪ��ORL�������ݿⲻͬ�㷨��ʶ���ʡ��ɱ�1�ɼ����ڲ�ͬ��ѵ�����������£���CRC�㷨��ȣ������㷨��ʶ���ʶ��������������������Gabor����ͼ�ܹ���������ͼ��ֲ���Ϣ�����ڹ��ա��������̬�ȱ仯���нϺõ�³���ԡ���ÿ��ѵ����������Ϊ5������£�MFGM-CRC-2�㷨��MGFM-CRC-3�㷨ȡ�������ʶ����99.8%��������ѵ������������£�MGFM-CRC-3�㷨ʶ���ʶ�Ҫ���������㷨��ʶ���ʣ�������CRC���������߲�ʹ��K���ڲ��Բ��ں϶�������ʶ��������һ��������㷨��³���ԡ�

��ͨ��ORL�������ݿ����Ƚϸ����㷨�ڲ�ͬѵ�����������µı��֡���1��ʾΪ��ORL�������ݿⲻͬ�㷨��ʶ���ʡ��ɱ�1�ɼ����ڲ�ͬ��ѵ�����������£���CRC�㷨��ȣ������㷨��ʶ���ʶ��������������������Gabor����ͼ�ܹ���������ͼ��ֲ���Ϣ�����ڹ��ա��������̬�ȱ仯���нϺõ�³���ԡ���ÿ��ѵ����������Ϊ5������£�MFGM-CRC-2�㷨��MGFM-CRC-3�㷨ȡ�������ʶ����99.8%��������ѵ������������£�MGFM-CRC-3�㷨ʶ���ʶ�Ҫ���������㷨��ʶ���ʣ�������CRC���������߲�ʹ��K���ڲ��Բ��ں϶�������ʶ��������һ��������㷨��³���ԡ�

��1����ORL�������ݿⲻͬ�㷨��ʶ����

Table 1��Recognition results of different methods on the ORL face database %

3.1.2��Extended Yale B�������ݿ⡡

Extended Yale B�������ݿ����38���ˣ�ÿ��64���ڲ�ͬ���������µ���������ͼ����ʵ����ԭʼ����ͼ�����سߴ��һ��Ϊ54���ء�48���أ���������ͼ�����ѡȡ50%��Ϊѵ��������ʣ��50%��Ϊ������������2��ʾΪExtended Yale B���������ʲ�ͬ�㷨��ʶ���ʡ�����Gabor�ֲ������������õı���ͼ�������������MGFM��ʾ���㷨���κ�����ά���¾���CRC�㷨ʶ��Ч���á���3������ά���£�MGFM-SRC��MGFM-CRC-3�㷨��ȡ������õ�Ч�������䵱����ά��Ϊ300ʱ����2�ַ�����ʶ���ʶ��ﵽ��100.0%(��MGFM-CRC-3�㷨Ч�����Ը���MGFM-SRC)�����⣬MGFM-CRC-3�㷨ʶ���ʸ���MGFM-CRC-1��MGFM-CRC-2�㷨ʶ���ʣ�ͬ����������MGFM���÷ַ�������ʽ����CRC���������߲�ʹ��K���ڲ��Բ�����������ʶ���������ںϣ�����������ʶ���ʡ�

��2����Extended Yale B�������ݿⲻͬ�㷨��ʶ����

Table 2��Recognition results of different methods on Extended Yale B face database %

3.1.3��AR�������ݿ⡡

����ʵ��ѡȡAR�������ݿ���100��(50�����Ժ�50��Ů��)ÿ��14������1 400����������ͼ���в�ͬ�Ĺ��պͱ���仯����ԭʼ����ͼ�����سߴ��һ��Ϊ66���ء�48���أ�����ѡȡǰ7������ͼ����Ϊѵ��������������Ϊ������������3��ʾΪAR�������ݿⲻͬ�㷨��ʶ���ʡ��ڲ�ͬά���£�MGFM-CRC-3�㷨��ȡ�������ʶ��Ч����

��3��AR�������ݿⲻͬ�㷨��ʶ����

Table 3��Recognition results of different methods on AR face database %

3.2���㷨Ч��

��4��ʾΪ�����㷨ʶ��һ������ͼ������Ҫ��CPUʱ�䡣�ɱ�4�ɼ���CRC�㷨ʶ��һ������ͼ������ʱ����٣�Ч���������ԡ�����MGFMϡ���ʾ��Эͬ��ʾ���㷨��Ҫ��ʱ������MGFM������ȡ�����ϡ����У�MGFM-SRC�㷨����ʱ����࣬ԭ��������L1-������С�������ϵ���������㷨���Ӷȣ������������3��MGFM-CRC�㷨�ڸ������ݿ��ϵ�ִ��ʱ�����������һ�£���Ч�����Ը���MGFM-SRC�㷨��������Ϊʹ����CRC������������L2-�������SRC�������е�L1-���������ϵ���������Ӷ���ȡ�ý�����,���¼�����Ӹ�Ч��

��4�������㷨ִ��ʱ��Ƚ�

Table 4��Run time comparison of various algorithms /ms

4 ����

1) ���ڶ��Gabor����ͼ (MGFM)��������ͼ���������ʾ������Ч��������ͼ��ֲ���Ϣ�����ڹ��ա��������̬�ȱ仯���нϺõ�³���ԡ�

2) ʹ��CRC������ʵ������ʶ��CRC�㷨���������ϵ��������ϡ���ԣ��������������ֵ�ԭ�ӵ�Эͬ���ã���L2-�������SRC�������е�L1-���������ϵ��������������ȡ�ý����⣬�����ܱ�����SRC�㷨�ӽ���ʶ���ʣ����Ҵ����������Ч�ʡ�

3) ԭʼCRC�㷨������Эͬ��ʾ�ع������з���ʱ����������������·�������ķ���ʹ������ӦK���ڲ��Խ��иĽ���ͬʱ�Զ��Gabor����ͼ����ַ�������ʽ���������ֻ��ƽ��з����о���ȡ���˽Ϻõ�Ч����

�ο����ף�

[1] ������, ��Сƽ, �����, ��. ϡ���ӿռ��������[J]. �Զ���ѧ��, 2015, 41(8): 1373-1384.

WANG Weiwei, LI Xiaoping, FENG Xiangchu, et al. A survey on sparse subspace clustering[J]. Acta Automatica Sinica, 2015, 41(8): 1373-1384.

[2] WRIGHT J, YANG A Y, GANESH A, et al. Robust face recognition via sparse representation[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2009, 31(2): 210-227.

[3] TURK M, PENTLAND A. Eigenfaces for recognition[J]. Journal of Cognitive Neuroscience, 1991, 3(1): 71-86.

[4] BELHUMEUR P N, HESPANHA J P, KRIEGMAN D J. Eigenfaces vs. Fisherfaces: recognition using class specific linear projection[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 1997, 19(7): 711-720.

[5] GAO Shenghua, TSANG I W H, CHIA L T. Kernel sparse representation for image classification and face recognition[M]//Computer Vision �C ECCV 2010. Berlin, Heidelberg: Springer, 2010: 1-14.

[6] YANG Meng, ZHANG Lei, YANG Jian, et al. Robust sparse coding for face recognition[C]//CVPR 2011. New York, USA: IEEE, 2011: 625-632.

[7] SHEN Linlin, BAI Li. A review on Gabor wavelets for face recognition[J]. Pattern Analysis and Applications, 2006, 9(2/3): 273-292.

[8] YANG Meng, ZHANG Lei, SHIU S C K, et al. Gabor feature based robust representation and classification for face recognition with Gabor occlusion dictionary[J]. Pattern Recognition, 2013, 46(7): 1865-1878.

[9] ������, ����, �����. ���ڶ��Gabor����ͼϡ���ʾ��³������ʶ��[J]. ����������ѧѧ��(��Ȼ��ѧ��),2019, 39(7): 732-737.

XU Wangming, ZHANG Pei, WU Shiqian. Face recognition via sparse representation of multi-directional Gabor feature maps[J]. Transactions of Beijing Institute of Technology, 2019, 39(7): 732-737.

[10] ����ɽ, ���ɰ�, ����¼. ����Gabor��ͨ����Ȩ�Ż���ϡ�����������ʶ��[J]. ��������Ϣѧ��, 2011, 33(7): 1618-1624.

YANG Qingshan, GUO Cheng��an, JIN Minglu. Face recognition based on Gabor Multi-channel weighted optimization and sparse representation[J]. Journal of Electronics and Information Technology, 2011, 33(7): 1618-1624.

[11] ZHANG Lei, YANG Meng, FENG Xiangchu. Sparse representation or collaborative representation: Which helps face recognition? [C]//2011 International Conference on Computer Vision, New York, USA: IEEE, 2011: 471-478.

[12] LIU Chengjun, WECHSLER H. Gabor feature based classification using the enhanced fisher linear discriminant model for face recognition[J]. IEEE Transactions on Image Processing, 2002, 11(4): 467-476.

[13] AMIN M A, YAN H. An empirical study on the characteristics of Gabor representations for face recognition[J]. International Journal of Pattern Recognition and Artificial Intelligence, 2009, 23(3): 401-431.

[14] OLIVA A, TORRALBA A. Modeling the shape of the scene: a holistic representation of the spatial envelope[J]. International Journal of Computer Vision, 2001, 42(3): 145-175.

[15] SAMARIA F S, HARTER A C. Parameterisation of a stochastic model for human face identification[C]//Proceedings of 1994 IEEE Workshop on Applications of Computer Vision. FL, USA, 1994: 138-142.

[16] GEORGHIADES A S, BELHUMEUR P N, KRIEGMAN D J. From few to many: illumination cone models for face recognition under variable lighting and pose[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2001, 23(6): 643-660.

[17] LEE K C, HO J, KRIEGMAN D J. Acquiring linear subspaces for face recognition under variable lighting[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2005, 27(5): 684-698.

[18] MARTINEZ A, BENAVENTE R. The AR face database[R]. Computer Vision Center, Technical Report 24, West Lafayette, USA: Purdue University, 1998.

���༭ ��������

�ո����ڣ� 2019 -04 -22; �����ڣ� 2019 -07 -10

������Ŀ(Foundation item)��������Ȼ��ѧ����������Ŀ(61775172, 51805386)������ʡ���������мƻ���Ŀ(D20191104)(Projects(61775172, 51805386) supported by the National Natural Science Foundation of China; Project(D20191104) supported by Department of Education Research Program of Hubei Province)

ͨ�����ߣ�����������ʿ��������ʦ������ͼ������ģʽʶ���о���E-mail: xuwangming@wust.edu.cn