�������Ҿ���������˶�������Ϊ�ָ��㷨

��Դ�ڿ������ϴ�ѧѧ��(��Ȼ��ѧ��)2014���4��

�������ߣ���ޱޱ ������ ���� �γ�

����ҳ�룺1128 - 1137

�ؼ��ʣ������˶��ָ�˶������ݣ������нǣ����Ҿ��룻����

Key words��human motion segmentation; motion capture data; joint angle; cosine distance; curve simplification

ժ Ҫ���������˶������ݽ�����Ϊ�ָ��������˶����ݷ�����ϳ��еĹؼ��������裬Ϊ�ˣ����һ���µ������˶�������Ϊ�ָ��㷨�����ù����н�ֱ��ͼ�̻������˶�ͳ��������ʹ���������ƶ���Ϊ�����˶����ݹ����н�ֱ��ͼ�����������Զ�����ʵ�ֶ��˶���Ϊ���Զ��ָ���ڸ����������˶������У����ȶ��廬���Ƚϴ��ڣ����㵱ǰ���ڷ�Χ���˶�����ǰ����2���ֹ����н�ֱ��ͼͳ���������������ƶȣ�Ȼ��ͨ�����˶������ϻ����ô��ڣ�����˶����е��������ƶ����ߣ�������Сֵλ�ü�Ϊ��ͬ������Ϊ�ķָ�㡣��CMU�����˶������ݿ��Ͻ�����ֵʵ�顣�о���������������㷨�ܹ�ʵ�ֶ������˶������ݵ��Զ���Ϊ�ָ��㷺���õĻ���PPCA����Ϊ�ָ����ȣ������㷨�������õ����ܡ�

Abstract: Considering that the human motion segmentation is one important process for human motion data analysis and synthesis, a novel segmentation algorithm for motion capture data was proposed to segment motions into distinct behaviors. The method was based on the assumption that motions with the same type had similar histogram of angle between bones. Angle histogram was employed to represent the human motion, and cosine distance was utilized to measure the similarity of motions represented by angle histograms. A motion sequence was given, and a sliding window which moved from the starting frame to the end was firstly defined. In each window, the cosine similarity between the first half window and the second half was computed, and so a cosine distance curve with the motion was obtained. The minimums of the curve identified the cut between different types of motion behaviors. The present method was tested on the Carnegie Mellon Motion Capture database. The results show that the method can achieve the automatic segmentation for human motion capture data, and has good motion behavior segmentation performance compared with the classical PPCA based segmentation algorithm.

��ޱޱ1��������1������2���γ�3

(1��������ͨ��ѧ ����ѧԺ��������100044��

2. ������ͨ��ѧ ���������Ϣ����ѧԺ��������100044��

3. ú̿��ѧ�о���Ժ��������100013)

ժҪ���������˶������ݽ�����Ϊ�ָ��������˶����ݷ�����ϳ��еĹؼ��������裬Ϊ�ˣ����һ���µ������˶�������Ϊ�ָ��㷨�����ù����н�ֱ��ͼ�̻������˶�ͳ��������ʹ���������ƶ���Ϊ�����˶����ݹ����н�ֱ��ͼ�����������Զ�����ʵ�ֶ��˶���Ϊ���Զ��ָ���ڸ����������˶������У����ȶ��廬���Ƚϴ��ڣ����㵱ǰ���ڷ�Χ���˶�����ǰ����2���ֹ����н�ֱ��ͼͳ���������������ƶȣ�Ȼ��ͨ�����˶������ϻ����ô��ڣ�����˶����е��������ƶ����ߣ�������Сֵλ�ü�Ϊ��ͬ������Ϊ�ķָ�㡣��CMU�����˶������ݿ��Ͻ�����ֵʵ�顣�о���������������㷨�ܹ�ʵ�ֶ������˶������ݵ��Զ���Ϊ�ָ��㷺���õĻ���PPCA����Ϊ�ָ����ȣ������㷨�������õ����ܡ�

�ؼ��ʣ������˶��ָ�˶������ݣ������нǣ����Ҿ��룻����

��ͼ����ţ�TP391 ���ױ�־�룺A ���±�ţ�1672-7207(2014)04-1128-09

XING Weiwei1, TONG Leiming1, ZHANG Yi2, REN Cheng3

(1. School of Software Engineering, Beijing Jiaotong University, Beijing 100044, China;

2. School of Computer and Information Technology, Beijing Jiaotong University, Beijing 100044, China;

3. China Coal Research Institute, Beijing 100013, China)

Abstract: Considering that the human motion segmentation is one important process for human motion data analysis and synthesis, a novel segmentation algorithm for motion capture data was proposed to segment motions into distinct behaviors. The method was based on the assumption that motions with the same type had similar histogram of angle between bones. Angle histogram was employed to represent the human motion, and cosine distance was utilized to measure the similarity of motions represented by angle histograms. A motion sequence was given, and a sliding window which moved from the starting frame to the end was firstly defined. In each window, the cosine similarity between the first half window and the second half was computed, and so a cosine distance curve with the motion was obtained. The minimums of the curve identified the cut between different types of motion behaviors. The present method was tested on the Carnegie Mellon Motion Capture database. The results show that the method can achieve the automatic segmentation for human motion capture data, and has good motion behavior segmentation performance compared with the classical PPCA based segmentation algorithm.

Key words: human motion segmentation; motion capture data; joint angle; cosine distance; curve simplification

���������ڼ����ͼ��ѧ�����У������˶��������ķ�չ[1]�������˶����������Ӵ������Ч������Щ�����ѱ�÷dz���Ҫ�����У����˶������ݵ���Ϊ���зָ��Ϊ�˶����ݷ�����ϳɵ�һ�����ɻ�ȱ����Ҫ�������̡�������ҪĿ���ǽ������в�ͬ�˶����͵ij����зָ�ɵ�һ���˶����γɾ��е�һ�˶����͵�����������Ϣ���˶�Ƭ�Σ��Ա����������˶����ݿ��е���֯�ʹ洢������Ϊ�����˶����ݵ���Ч�����Լ����嶯���˶��ϳɵ��������õȴ����������������һ���µ��ල�������˶������ݵ��Զ���Ϊ�ָ��㷨��������һ������н�ֱ��ͼ��ʾ�����˶����е���̬�����������н�[2]��ӳ�������˶���������������������һ���˶��������У�����ѡȡ���̻ܿ������˶���̬����Ҫ�����н���Ϊ�ؼ��ǣ�Ȼ��ÿ���ؼ������н���ֵ�����б仯���������ֱ��ͼͳ�ƣ����������йؼ��ǵ�ֱ��ͼͳ������������Ϊ�����˶����е���������������һ�ΰ��������˶����͵������˶����У����廬���Ƚϴ��ڣ����űȽϴ����������ϴ�������յ㻬�������㵱ǰλ�ñȽϴ�����ǰ��������2�����˶����еĹ����н�ֱ��ͼ�������������ƶȣ��Ӷ���ø����е��������ƶ���ֵ���ߡ��Ƚϴ�����ǰ����2�벿�ֵ������˶���̬����Խ���ƣ���Ӧ���������ƶ�Խ�ӽ���1�����ԣ��˶�������2����ͬ�˶������л������������ƶ��������1���ȣ��������ƶ������ϵ�������Сֵ����Ӧ�Ų�ͬ�����˶���Ϊ�ķָ�㡣Ϊ�˱����������ƶ������ϵ���������ֵ�����ȶ������˶���Ϊ�ָ���жϵ�Ӱ�죬����ʹ�������㷨���������ƶ����߽��н��Ʊ�ʾ���Ӷ�����2�β�ͬ�����˶���Ϊ���зֵ㣬ʵ�ֶ��˶����ݵ���Ч�ָ

1 ��ع���

�����˶��������ķ�չ�������˶������������Ӵ�Ϊ����Ч��������Щ�˶����ݣ�ʹ���߳�����Ҫ�������еĸ�ά�����˶����ݰ��������˶����͵���������������Ч�ָ����Ϊ���е�һ�˶����͵�����Ƭ�Σ��Ա��ں����������˶������ݽ��з������ϳɡ���֯�����ȴ�����Ӧ�á������˶���Ϊ�ķָ���ȡʵ�ֶ�ԭʼ�������˶������ݽ��о�ȷ����Ϊ�ָ�Դ���Ϊ�����˶����ݵĽṹ��������ϳɵ����ݴ����Ļ������ѳ�Ϊ�������о���Ա��ע���о��ȵ㡣�����о���ԱΪ�˽����˴����о���������ȡ����һϵ���о��ɹ������ڵ�һЩ�о�����ֱ�۵ĵͲ��˶�����Ϊ�����ָ��˶����ݡ����磬Pomplun��[3]����˻��ڹؽڿռ�(joint-space)���˶��ָ��㷨��Fod��[4]ͨ���������ؽ��˶����ٶȹ����ķ����ָ������˶����ݡ�

���ԭʼ�����˶�������ά���ߡ�����������������⣬һЩ�о�������������ݽ�ά�ķָ����Barbic��[5]��Ϊ��ͬ�������˶���Ϊ�����ò�ͬ�ı���ά������ʾ��ͨ�����ɷַ���PCA(principal component analysis)�������˶����ݽ�ά�������˶����͵�PCA�ӿռ�ȵ�һ�˶���PCA�ӿռ��и��ߵ�ά�ȣ���ˣ�������ӿռ���ͨ��ͶӰ����������Ϊ�ָ���λ�á�Ф��[6]�����һ�ֻ��ڷ��������ε���ά�����˶����ݵ���Ϊ�ָ�������÷��������ν�ά����ISOMAP(isometric mapping)�������˶����ݽ��н�ά��ʹ��k-��ֵ�㷨�������˶����࣬�Ӷ����Ը���ȷ�صõ���Ϊ�ָ�㡣���ε�[7]�����һ�ֻ��ڷֲ������˶���������ȡ�ؼ�֡�ķ�����Peng[8]������Ǽܷ�Ϊ��֫����֫2���֣����ý�ά������ľ�����������ʾ��ά�����˶���ͨ��ʹ�õ�ͨ�˲����������˶����ݽ��н����Եõ���Ϊ�ָ�㡣

��һ��ָ��ͨ����Ʒ������������ƣ�ʵ�ֶ������˶����ݵ���Ϊ�ָArikan��[9]ͨ������֧��������SVM(support vector machine)���˹���ע��ѵ�����ݼ����������˶����ݵ���Ϊ�ָKahol��[10]���ö�̬��νṹ��ʾ�������ѧ������ʹ�����ر�Ҷ˹(naive Bayes)��������������˶����ݵ���Ϊ�ָ���ǣ����ַ����ںܴ�̶��ϱȽ�������ѵ�����ݼ��;���ֵ����Ծ����[11]�����һ�ֻ��ڡ��˶��������˶��ָ�����˶����ݾ������ࡢʱ��ظ������ֵ�˲������� ���˶��������������˶������ݵĻ����ϣ�����Щ���˶��������з����ͷ��࣬�Ӷ�ʵ���˶����ݵ���Ϊ�ָZhou��[12]���ö���������ACA(aligned cluster analysis)������������˶����ݵ���Ϊ�ָ���ַ���ͨ�����붯̬ʱ�����˵ĸ��������ͬ���ȵ��˶�����Ƭ�ε������ԣ����ú�k-��ֵ��������˶��ķ��࣬�Ӷ��ﵽ��Ϊ�ָ��Ŀ�ġ�

���⣬һЩ�о�������˻���ģ�͵������˶����ݷָ����Barbic��[5]�ڻ���PCA��Ϊ�ָ�Ļ���������˻���PPCA����Ϊ�ָ������Ϊ��ͬ�˶����͵����ݾ��в�ͬ�ĸ�˹�ֲ������Ը�������֮������Ͼ�����ȷ����Ϊ�ָ�㡣���⣬���ǻ�ʹ�ø�˹���ģ��GMM(Gaussian mixture model)�Բ�ͬ�˶����͵����н��о��࣬������֡���ڲ�ͬGMMģ��ʱ����ȷ����Ϊ��Ϊ�ָ�㡣Wang��[13]ʹ���������ɷ�ģ��HMM(idden Markov model)���˶����о��࣬�ܹ�����Ȼ����зָ���˶�ԭ��Ƭ�Ρ�Wang��[14]ͨ��ʹ�ú˶�̬���������ڶԳƵ������˶����ݽ��зָ��Ի�ȡ���ǵ��˶�ԭ��Ƭ�Ρ�Lu��[15]����˻���˫��ֵ��ά�ָ��㷨�����Խ��Ƚϸ��ӵ������˶����ݷֽ��һ���Ķ�̬����ģ�����У��Ӷ��õ��ָ�㡣

����ά�����˶����ݴ����У�������ѧ��������ֲ�ͬ����ά�����˶�������ʾ��������ͳ����ͨ������ԭʼ�˶�������̬�Ĺؽڵ�λ�á��ؽڽǶȡ����ٶȡ��Ǽ��ٶȵȱ�ʾ��Lee��[16]�����һ��2��Ľṹ�˶������ı�ʾ��������Ͳ��һ�����п��ɼ�һ��Markov���̣��̻��˶�ϸ�ڣ��߲�ͨ��ͳ��ģ�Ͷ��˶����ݿ���о��������Muller��[17]�����ϵ������ʾ������ʹ��һ�鲼����ֵ���Ե����������˶�����������Ǽܶ���ѧ���ض���֮���Լ�������岿��֮��Ŀռ伸�ι�ϵ������Ф����[2]�����������Ҫ�����н���Ϊ��ԭʼ�˶����ݵļ���������ʾ��ѡ������Ǽ�����֫���ֵ�8����Ҫ������Ϊ������ʾ������ȡ��8�ι�������Root�ؽں�Chest�ؽ���ɵ����Ĺ���֮��ļн���Ϊ�˶�������������������Ǽ���֫�����������˶��б仯�����ԣ������˶������ϸ������ԣ������нǼ��ܱ�ʾ��ά������̬��������ַ�ӳ�����˶����ͱ仯�����ܼ���ؽ���ԭʼ��ά�����˶����ݵ�ά�ȣ�Ϊ�ˣ������ڲ��ù����н���Ϊ��ά�����˶�������ֵ��ʾ�Ļ����ϣ����ʹ�ù����н�ֱ��ͼͳ�����������������˶����ݵ���Ϊ�ָ���⣬���ǵ�ֱ��ͼͳ�������лᶪʧԭ�������˶����еIJ���ʱ�����������磬һ���ܺ�һ�����Ĺ����н�ֱ��ͼ���ܻ����ƣ�����ǰ����˫�ֺ�˫��ʼ�ձ���һǰһ���ں�����˫����˫�ŵ��˶�������һ�µģ���ˣ���ԭ��8�ι����нǻ����ϣ������������ϱۼ�Ĺ����нǺ����Ҵ��ȼ�Ĺ����нǡ�

���IJ������Ҿ������2�������˶�����Ƭ�������������ԡ����Ҿ�����Ϊһ�����������Զ������ƣ�ͨ������2�������ڻ��ռ�ļнǵ���������������֮��������ԣ��������κ�ά�ȵ������Ƚϣ������ڸ�ά���ռ��С����Ҿ���㷺Ӧ������Ϣ�������ı������ȷ���[18-20]�����У��ı�ͨ������ģΪ��Ƶ����(term�Cfrequency vector)�������ض��ı����������ʻ�����ֻռ���дʻ㼯��һ���֣���Ƶ����ͨ��Ϊһ����άϡ����������ˣ������Ƶ�������ƶ�ʱ����Ҫ���Բ�ƥ��Ĵʻ㣬ֻ��2���ĵ��ж����ֵĴʻ�Ƶ�ʽ��бȽϣ���ʹ��2����Ƶ����֮��нǵ����ҽ��ж�����Ȼ�ȴ�ͳŷʽ����ȶ�����������ȷ�����IJ��ù����н�ֱ��ͼ��Ϊ�����˶�����ͳ��������ͬ�����и�άϡ���������ص㣬ʹ�����Ҿ������2�����������ڸ�ά�ռ�ֲ��ϵķ�����죬����ڱȽ�2��������ֵ�����Ը���ֱ�ۣ��������������ԣ���ˣ���������������Ҿ���������˶���������ͳ�����������������Զ������ơ�

2 ������ȡ���˶������Զ���

2.1 �����н��˶�������ȡ

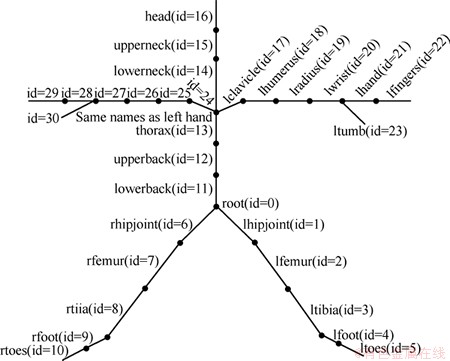

ԭʼ���˶�������������һϵ����̬֡��ɵ��˶����У�ÿһ֡������1����ιǼ�ģ�͡����ؽ�(root)����6�����ɶȣ�����3�����ڱ�ʾ����Ǽ�����������ϵ�е�λ�ã�����3������Ǽ�����������ϵ�еij���������ؽڣ�����3�����ɶȣ���ʾ��������ڸ��Ը��ؽڵ���ת�Ƕȡ�ͼ1��ʾΪ����ʹ�õ�����Ǽ�ģ�͡�

ͼ1 ����ʹ�õ�����Ǽ�ģ��

Fig. 1 Human skeleton model used in this paper

�����˶����Ͳ�������������λ�úͳ���IJ�ͬ�������仯����ˣ����IJ����Ǹ��ؽڵ����á���ͨ������£�������֫�������ı仯������������������������˶����ͣ�ͷ���ֺͽ���3����λ�ı仯û�й��ɣ����˶��ıȽϻ���ɺܴ�Ӱ�죬�����Ƕ��������˶����͵����������dz�С��Ϊ�ˣ����IJ��ø�����(Broot)����֫���ֵ�8�ι���(Bi, i=1������8)֮��Ĺ����н�[2]��Ϊ����ÿһ����̬���˶����������1��ʾ�����йؽڵ��λ�ñ�ʾ����root��lowerback��l-clavicle�ȷ�����ͼ1�еĸ��ؽڵ�ķ���һһ��Ӧ����B1��ʾ�ɸ��ؽ�λ��l-clavicle(id=17)ָ���ӹؽ�λ��l-humerus(id=18)�Ĺ�����������������������������ͬ���ı�ʾ���塣

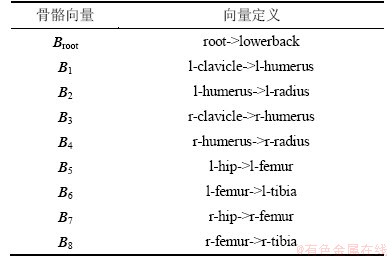

��1 ������������ʾ

Table 1 Bones definition as vectors pointing from parent joint position to the child

���⣬��һ�����˶�����Ծ�˶��У��첲��������������ɵļнǵķֲ�������̫�����𡣵���·ʱ�첲������һǰһ����Ծʱ���첲������ͬʱǰ�졣���������۲죬Ϊ�˽�һ������˶���������������������������������2�������нǣ��������ϱ۹���B1��B3֮��ļн��Լ����Ҵ��ȹ���B5��B7֮��ļнǣ����1�е�8�������нǹ�ͬ��Ϊ�����˶���̬��������

��Щ�����нDz����ܹ�ֱ�۵ط�ӳ�����˶����������壬�����ܹ�����ԭʼ��ά�˶����ݵ�ά��[7]��������Broot�͵�i�ι���Bi֮��ļнǦ�iͨ��ʽ(1)����õ���

(1)

(1)

���⣬��һ�����˶�����Ծ�˶��У��첲��������������ɵļнǵķֲ�������̫�����𡣵���·ʱ�첲������һǰһ����Ծʱ���첲������ͬʱǰ�졣���������۲죬Ϊ�˽�һ������˶�����������������������������2�������нǣ��������ϱ۹���B1��B3֮��ļнǦ�9�����Ҵ��ȹ���B5��B7֮��ļнǦ�10�����1�е�8�������нǹ�ͬ��Ϊ�����˶���̬��������

2.2 �����н�ֱ��ͼ���˶������Զ���

���IJ���ֱ��ͼ�������˶�������10�������нǵķֲ�������2���˶����еĹ����н�ֱ��ͼ֮��ľ�����Ϊ�˶����е������Զ��������DZ��ķָ��㷨�Ļ��������ڲ�ͬ���͵��˶���������нǵı仯��Χ�Dz�ͬ�ģ�������֮��ļн�������0����֮�䣬��ˣ�ÿ�������нǵ�����Ϊ0������Ϊ�С�

���ڸ�����1���˶�����M��Ϊ�˼�������нǵ�ֱ��ͼ�����Ľ�[0����]ƽ������ΪL�����䣬�������¼��㹫ʽ[21]ȷ��L��

L=[log2N+1] (2)

���У�NΪ�˶�����M��������֡������Ӧ�أ���[0����]���γ���l+1���߽磬��Щ�߽���Ա�ʾΪ

(3)

(3)

����Щ�߽繹�ɵ����䶨��Ϊ

(4)

(4)

��i�������нǵ�ֱ��ͼ���㹫ʽΪ

(5)

(5)

���У�mjΪ�˶�����M�е�j�������нǦ�i���������j�ڵ�Ƶ����j=1��2������10����Ӧ�ڱ���ѡȡ��10�������нǡ��˶�����M�е�ÿ�������нǵ�ֱ��ͼHi��һ��1��L����������M��10�������нǵ�ֱ��ͼ������β����������1���µ�1��10L������YM����Ϊ�����˶�����M������������

��ͨ������£�һ���˶�����������нǵĻ��Χ�����Ƕ��ܹ�ռ��[0����]�������Ƕȿռ䣬���ǣ�[0����]��L����������Щ�����Ӧ��Ԫ��Ϊ0����ʾ�˶��й������ɴ�ķ�Χ�ռ䡣�ɼ��������н�ֱ��ͼ������һ����άϡ�����������IJ������Ҿ���������2����ά��������֮��������ԣ�����ͨ������2������֮��нǵ�������ʵ�֡�

�������������2���˶�����M1��M2 ���ֱ���ȡ����Ӧ����������YM1��YM2��������M1��M2֮������Ҿ�����㹫ʽ���£�

(6)

(6)

�˶�����M1��M2Խ���ƣ����Ӧ����������֮��ļн�ԽС��Dis(M1��M2)ҲԽ�ӽ���1��

���ڹ����н�ֱ��ͼ���˶�����������ԭʼ�˶����ݽ��н�ά�����ұ������������Ƶ��˶�����ʱ�ձ仯�����µ���ֵ�ϵIJ���[22]�����⣬�ڽ��������Զ�������ʱ�����ĵĹ����н�ֱ��ͼ�˶���������Ҫ�����DTW(dynamic time warping)���˶������Զ�������[16, 23]һ����Ҫ����Ԥ��ʱ����봦����

3 �˶��ָ�

3.1 ���ƶ�������

�ڼ���õ��˶����������������Զ���ֵ����Ҫ�����1���˶����е����ƶ����ߡ����ڸ�����һ���˶�����M��������M�϶���1����������W�����ڴ�СΪS������ÿ�λ����������Ը��ݲ�ͬ��������Զ��壬���Ľ����ڲ�������Ϊ1֡����ʼ���ڵ����Ե���˶�����M�ĵ�1֡���룬���1�����ڵ��ұ�Ե���˶�����M�����1֡���롣���ĵĻ������ڶ���Ϊ

(7)

(7)

m=0��1��2������M��M=N-S

���У�mΪ��ǰ���ڵ���ţ�f(k)Ϊ�ô��ڰ������˶�����M�еĵ�k֡�����ڻ��������е�ÿһ������W(m)����ȡ��ǰ������ڶ�Ӧ���˶�Ƭ�ε���������Yfirst-half�ͺ������ڶ�Ӧ���˶�Ƭ�ε���������Ysecond-half��Ȼ�������Ҿ������ô�����ǰ����2�����˶�Ƭ�ε����ƶȣ�����ʽ��ʾ��

(8)

(8)

���ǣ�����s(W(m))�õ�1�����ƶ����ߣ���������ʼ���˶�����M�ĵ�S/2֡����ֹ�ڵ�N-S/2֡��

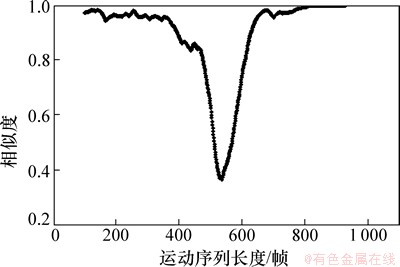

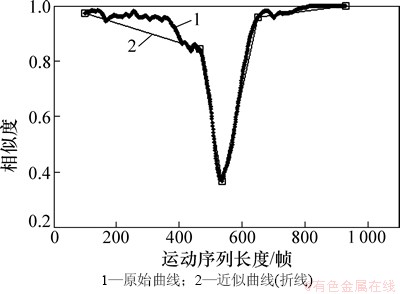

��Mֻ����1���˶����ͣ���ÿ��������ǰ��2���˶�Ӧ������ͬһ���˶��ࡣ����ʽ(8)��s(W(m))���ӽ���1���õ������ƶ�������1���ӽ���1��ˮƽ�ߡ���M��1����2���˶�ǰ�����������ɵ��˶����У����������ڵ�1���˶��ϻ���ʱ�����ƶȱ�����Ժ㶨������2���˶����뻬������ʱ�����Ƚ�����ǻ������ڵĺ�벿�֣���ʱ�����ڵ�ǰ����2���˶������ƶȽ���С������2���˶���ȫռ�ݻ������ڵĺ�벿��ʱ�����ڵ�ǰ����2���˶�Ϊ2�ͬ���˶�����ˣ���������ƶȽ�������С�����Ż������ڼ�������ƶ�����2���˶���ʼ���봰�ڵ�ǰ�벿�֣���ʱ�����ڵ�ǰ����2���˶�֮������ƶ���ʼ��������������ȫ�����2���˶�ʱ�����ƶȴﵽ�����ͼ2��ʾ��ͼ2�У��˶�����M����2���˶���Ϊ��ÿ���˶�������Լ500֡���������ڵĴ�СL����Ϊ100����ͼ2���Կ������˶�������2���˶���Ϊ�ķָ��Ϊ���ߵļ�Сֵ�㡣

�������ڳ��ȵ�ѡ��Ӧ��������2��������

(1) ��������Ӧ�����㹻���ȣ�����Ӧ�����˶�����M����������˶���2�����ڣ�������ֵ��˶�����֡���ݲ��ܹ���ӳ������Ϊ���˶�������Ϣ��ֻ�����������ڵ�ǰ����2�벿�ֲ��ܻ�ȡ�㹻��������������Ч�Ĺ����н�ֱ��ͼ��

ͼ2 ����2���˶���Ϊ���˶�����M�����ƶ�����

Fig. 2 Similarity plot motion sequence M including two behavior sequences

(2) �������ڵ�һ��ӦС���˶���������������ȫ���˶�������������˶�Ƭ�εij��ȡ���ͼ3��ʾ����ɫ�ͻ�ɫƬ�ηֱ��ʾ2���˶����У����У���ɫ�˶�����С�ڴ��ڵ�һ�롣�������������ĵ��A�㻬����B��ʱ����ɫ�˶����봰�ڣ�����ǰ����2�벿��֮������ƶ���С�����������ڴ�B����C��ʱ�����ں�봰���е�2���˶�ռ�ݱ������ֲ��䣬��ʱ,���ƶ�Ҳ���ֺ㶨����C�㻬��D��ʱ�����ƶȿ�ʼ���ӡ���ͼ3���Կ�����C������Ϊ�ָ�㣬������������£�B��Ҳ�����ױ�ѡ��Ϊ�ָ�㣬���Dz����ָ������ˣ������û������ڳ���ʱ����ߴ��һ��ӦС���˶������е�����˶������˶�Ƭ�Ρ�

��ˣ���Ҫ������Ϊ���͵��˶����ڼ���̵��˶�����Ƭ�γ��ȣ��趨�ʵ��Ļ������ڳ��ȡ�

ͼ3 ����һ������˶������д��ָ������������˶�Ƭ��ʱ�Ĵ���ָ�

Fig. 3 Error case of segmentation when half of window size is larger than the shortest behavior clip in the motion sequence

3.2 �ָ����

����һ���˶����У��ܹ�����õ�1����Ӧ�����ƶ����ߡ���������������֪�����ƶ����ߵļ�Сֵ��Ϊ��ͬ�˶����͵ķָ�㣬���ĵ�Ŀ������ҳ����ƶ������ϵļ�Сֵ�㡣Ϊ��ȷ���ָ�㣬��ֱ�ӵ�������ͨ��������ֵ��ѡ��С�ڸ���ֵ�ĵ���Ϊ�ָ�㡣Ȼ�������ڸ������˶�����������2�������˶�֮�����С���ƶȲ�����Ԥ��ȷ������ˣ���ֵ�������ʺϡ���һ���˶������У���ʹ������ͬ���͵��˶�����ͬ���ڵ��˶���̬Ҳ���в��죬��ᵼ�����ƶ����߲������������⣬�������ڳ��ȵ�ѡ��Ҳ������ƶ����߲���Ӱ�졣��ʵ����������ԭ���µ����ƶ����߲����ķ���ԶԶС�����˶����ı�����IJ������ȣ���ˣ����IJ��������㷨���������ƶ������н�С�IJ����仯�������ϴ�IJ����仯���ﵽ�ָ�����Ŀ�ġ�

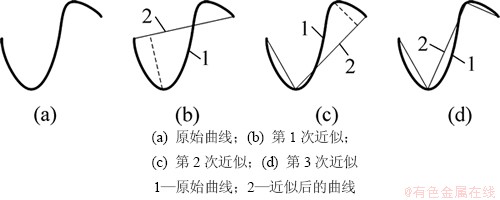

���ڵõ������ƶ�����(��ͼ4(a)��ʾ)�����������Ӹ�������β���˵���߶������Ʊ�ʾ������(��ͼ4(b)��ʾ)������Ч������ͨ���������ߵ����߶ε������������������þ������Ԥ���趨����ֵ�����߶�2���˵������ߵ����߶���Զ����ĵ�ֱ���������ɾ�����߶�(��ͼ4(c)��ʾ)��Ȼ�ù���һֱ�ݹ�ֱ��������С����ֵΪֹ����ͼ4(d)��ʾ��

ͼ4 �����㷨ʾ��

Fig. 4 Demonstration for curve simplification

�����㷨�е���ֵΪ����ֵ��ͨ��ʵ��������á����ù���ὫһЩ�ָ����ԣ���С���ܵ����������ݲ�����Ӱ�죬���ܻ�ѡ��һЩ����ķָ�㡣ͼ2�е����ƶ����߾�����������õ��Ľ���������ͼ5�е�������ʾ������ͨ���ڰ���������˶�����ѵ���������Ͻ��е�ʵ����ȷ�������е���ֵ���ݴ�������ֵΪ0.08��ͼ5��С�����ǽ������ߵ����ӵ㣬Ϊ���ҵ��ָ�㣬��Ҫ����Щ���ӵ��м�����Сֵ����ͼ5���Կ�������Сֵ�ĵ���������ڵ����ӵ㹹�ɵ�ֱ��б��Ϊ�������ұ����ڵ����ӵ㹹�ɵ�ֱ��б��Ϊ������ˣ����Ը��ݸ÷�������Щ�������ӵ��п�����ȡ���˶����еķָ�㡣

ͼ5 �˶��������ƶ����ߵļ��

Fig. 5 Simplification result for motion sequence similarity curve

4 ʵ����������

Ϊ�˽�һ��˵���㷨�������Ժ���Ч�ԣ��������2��ʵ�顣ʵ������ѡ������CMU�������˶������ݿ�[24]�����˶����ݲ���AMC��ʽ[25]����������ʹ��ŷ���ؽڽǡ�

4.1 ���������Զ�������Ч��

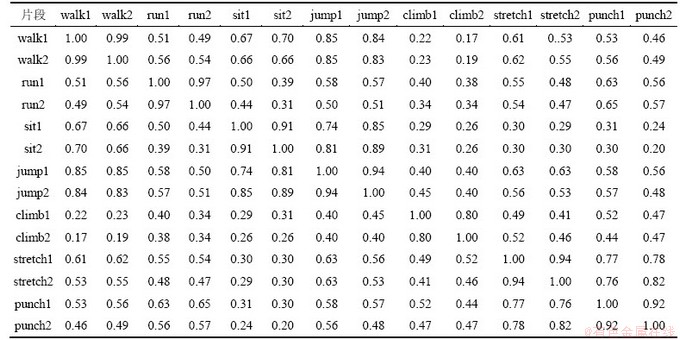

��CMU���ݿ�ѡȡ7�ͬ���˶���������(walking)����(running)����(sitting down)��ǰ��(forward jumping)����(climbing)�����ֱ�(arm stretching)����ȭ(punching)���������ݿ��������ȡ��7���˶���Ϊ��14���˶����У�ÿ�����2���˶����У�ÿ�����г���Ϊ240֡��2����ͬ���͵��˶�Ƭ��֮����������ƶ�������Ӧ�ýӽ���1��Ϊ����֤�㷨����ȷ�Ժ���Ч�ԣ�����14��14�������Ծ������ÿһ��Ԫ�����������к��ж�Ӧ��2���˶����е��������ƶȣ����2��ʾ��

��ʵ�ϣ�ÿ���˶��������������ƣ����ƶ�Ϊ1����ͬ���˶��IJ�ͬ����Ƭ��ҲӦ�þ��кܸߵ����ƶȡ��������Ծ�����У��û�ɫ���α�ʶ���ĶԽ���Ԫ����2��ͬ���˶���ͬƬ�κ�ͬ�ͬƬ��֮����������ƶȡ��ӱ�2���Կ�����ͬ���˶���ͬƬ�ε����ƶ�Ϊ1��ͬ���˶���ͬƬ��֮��Ҳ���б������˶�Ƭ�θ��ߵ����ƶȣ��ӽ���1�����磬run1��run2֮������ƶ�Ϊ0.97��jump1��jump2֮������ƶ�Ϊ0.94��ʵ����������������������Ҿ�������������˶�����������Ƭ�ξ������õ���������������������Ϊʵ���˶������ݵ��Զ�����Ч�ָ��������������

4.2 �˶����е��Զ��ָ�

��CMU���ݿ���ѡȡ�Ե�86��ʵ���߲ɼ���14�������˶����������У�ÿ���˶����д�Լ8 000֡������Լ10�������˶���������(walking)����(running)����ȭ(punching)����(climbing)�ȣ�ÿ���˶���Ϊ������Ϊ50~200֡����3��ʾΪʵ�����˶��������ݼ�����ϸ��Ϣ��

Ϊ�˲��Ա��ķ����ķָ�Ч�������˶����еķָ�������Ԥ���˹����֣�������Ϊ�㷨�Զ��ָ����ıȽϱ�������Barbic��[5]����Ļ���PPCA���˶��ָ��㷨���бȽϡ������˶���Ϊ�ķָ�ʵ������ͼ6��ʾ��

��ͼ6���Կ������ڲ����˶����ݵķָ�ʵ���У������������˶���Ϊ������PPCA���㷨�����߹����еĹ��䴦��õ�1���ָ�㣬����ؽ�ͬһ�����˶���Ϊ�ֳ���2�ࡣ���磬ͼ6(a)���˶�����86_03.amc�ĵ�1�������1���ָ�㣬ͼ6(b)���˶�����86_05.amc��ͼ6(d)���˶�����86_08.amc��ͼ6(e)���˶�����86_11.amc��ͼ6(f)���˶�����86_13.amc�ĵ�1���ָ�㣬ͼ6(c)���˶�����86_07.amc�ĵ�8���ָ�㡣

��2 7���˶�14�����е�������

Table 2 Similarity of 14 motion sequences belonging to 7 behaviors

ͼ6 �˶��ָ�Ƚ�ʵ����

Fig. 6 Comparison experimental results between our method and PPCA algorithm for motion segmentation

��3 ʵ����������Ϊ�ָ�������˶���������

Table 3 Human motion data sequences of behavior segmentation used in experiments

��ͼ6(b)�У�����86_05.amc�˶����У��ֹ��ֳ��ĵ�4���ָ���ǽ�ǰ�������ȵ������ֿ�����PPCAȴ©��������ָ�㡣�������ݿ��вɼ���ԭʼ�˶��������У����ֹ��ֳ��ĵ�9�͵�10���ָ��֮����һ�Ρ������ֱۻӴĶ�����PPCAȴ�����Ϊ2�Ρ���ͼ6(e)�У�����86_11.amc�����ֹ��ָ�ĵ�2���ָ���ǽ�˫����չ���ұ۵�����չ2���˶��ֿ�����4���ָ���ǽ�˫����չ����۵�����չ�ֿ�����ͼ6���Կ�����ʵ�����������㷨��ֵ��Ϊ0.08������£��ֹ��ָ��еĵ�2���͵�4���ָ��û���ҵ���������ͨ��������ֵ����ʵ�ֲ�ͬ���ȵ��˶���Ϊ�ָ��ͼ6(f)�У�����86_13.amc�����ֹ��ָ�ĵ�4���͵�5���ָ��֮����һ�ξ�ֹվ���Ķ�����PPCAȴ��������ǰ���������˶��ں���һ���û�зֿ����ֹ��ָ�ĵ�6���͵�7���ָ��֮����һ�Ρ�վ���������Ĵ��������Ķ�����PPCAȴ����ֳ���3�Ρ��ֹ��ָ�ĵ�7���͵�8���ָ��֮����һ�ζ��ݵġ�վ��������ָ�㡱���������ڸö�����ǰһ��������������ҳ���ʱ��̣ܶ���ˣ���2�ַ�����û�н���ָ��

Ϊ�˽�һ��˵����������ķָ��㷨�����ܣ��������˶��ָ�ʵ������ȷ��(p)���ٻ���(r)����Ncorrect��ʾ�㷨��������ȷ�ķָ����Ŀ��Treport��ʾ�㷨�����ܵķָ����Ŀ��Thuman��ʾ�ֹ��ָ�����Ŀ����ȷ�ʶ���Ϊ

(9)

(9)

�ٻ��ʶ���Ϊ

(10)

(10)

����ʵ���е�14���˶����У�ͨ��ȷ�ʺ��ٻ��ʱȽ��˱���������㷨��PPCA�㷨�ķָ��������4��ʾ��

��4 ����COSINE�㷨��PPCA��ȷ�ʼ��ٻ���

Table 4 Precision and recall of our COSINE based method and PPCA algorithm

��ȷ�ʿ�֪��������ķ�����PPCA������ʵ�����ݿ����ܹ��õ�������ȷ�ķָ�㣬���ٻ��ʿ�֪�����㷨�õ��ķָ������Ч�ָ����࣬Ҳ˵�����㷨���õ���Ϊ�ָ����ܡ�

��˵�����ǣ��������ƶ������Ǵ��˶����еĵ�S/2֡��ʼ����N-S/2+1֡��������ˣ�[1��S/2]��[N-S/2+1��N]��2�η�Χ�ڵķָ�㽫���ⲻ����Ϊ�˱�������⣬���������ô��ڳ���ʱ����֤���ڳ��ȵ�һ��С����������˶����͵�����˶�����Ƭ�γ��ȣ���������[1��S/2]��[N-S/2+1��N]�ķ�Χ�ڣ��������ڷָ�㣬�Ӷ���֤�˱����㷨��³���ԡ�

5 ����

(1) ����˶�������ϳɵ�һϵ���˶��������÷����Ե�һ�����˶����е������������һ���µ��ල�������˶��������˶���Ϊ���Զ��ָ��㷨�����˶������Զ�����Ϊ��ͬ���͵���Ϊ�˶����㷨ͨ���������������˶�������̬��ÿ�������нǵ�ͳ��ֱ��ͼ����ȡ�˶����е������������ڴ˻����ϣ���������˻������Ҿ�����˶����������Զ������㷽������ͨ�����廬�����ں����õ��˶����еķָ�㡣

(2) ���ù����н�ֱ��ͼ��Ϊ�˶����е�����������������ԭʼ�˶����н����˽�ά�������������Զ������������ʱ�ձ仯��������Ӱ�죬����ҪԤ�Ƚ���ʱ�������㡣�ɼ������ĵĹ����н�ֱ��ͼ���������Ҿ����������С�˶��˶����н��бȽϵļ�������������㷨������Ч�ʣ�ʵ����Ҳ���˵�����㷨�ڽ����˶���Ϊ�ָ��ϵ���ȷ�ԡ���Ч�Ժ��������ܡ�

�ο����ף�

[1] Moeslund T B, Hilton A, Kruger V. A survey of advances in vision-based human motion capture and analysis[J]. Computer Vision and Image Understanding, 2006, 104(2/3): 90-126.

[2] Ф��, ׯԽͦ, ���. ��ά�����˶��������ӻ��뽻��ʽ�˶��ָ�[J]. ����ѧ��, 2008, 19(8): 1995-2003.

XIAO Jun, ZHUANG Yueting, WU Fei. Feature visualization and interactive segmentation of 3D human motion[J]. Journal of Software, 2008, 19(8): 1995-2003.

[3] Pomplun M,  M J. Evaluation metrics and results of human arm movement imitation[C]//Proceedings of International Conference on Humanoid Robotics (Humanoids 2000). Boston, USA: IEEE-RAS, 2000: 7-8.

M J. Evaluation metrics and results of human arm movement imitation[C]//Proceedings of International Conference on Humanoid Robotics (Humanoids 2000). Boston, USA: IEEE-RAS, 2000: 7-8.

[4] Fod A, Mataric M, Jenkins O C. Automated derivation of primitives for movement classification[J]. Autonomous Robots, 2002, 12(1): 39-54.

[5] Barbic J, Safonova A, Pan J Y, et al. Segmenting motion capture data into distinct behaviors[C]//Proceedings of International Conference on Graphics Interface. Ontario, 2004: 185-194.

[6] Ф��. �������嶯�����ɹؼ������о�[D]. ����: �㽭��ѧ�������ѧ�뼼��ѧԺ, 2007: 42-50.

XIAO Jun. Study on intelligent human animation key techniques[D]. Hangzhou: Zhejiang University. School of Computer Science and Technology, 2007: 42-50.

[7] ����, Ф��, ���, ��. ���ڷֲ������˶��������ݹؼ�֡��ȡ[J]. ��������������ͼ��ѧѧ��, 2006, 18(11): 1691-1697.

YANG Tao, XIAO Jun, WU Fei, et al. Extraction of keyframe of motion capture data based on layered curve simplification[J]. Journal of Computer-Aided Design & Computer Graphics, 2006, 18(11): 1691-1697.

[8] Peng S J. Motion segmentation using central distance features and low-pass filter[C]//Proceedings of International Conference on Computational Intelligence and Security. Nanning, China: IEEE, 2010: 223-226.

[9] Arikan O, Forsyth D A, O��Brien J F. Motion synthesis from annotations[J]. ACM Transactions on Graphics, 2003, 22(3): 402-408.

[10] Kahol K, Tripathi P, Panchanathan S, et al. Gesture segmentation in complex motion sequences[C]//Proceedings of International Conference on Image Processing(ICIP 2003). Barcelona, Spain:IEEE, 2003: II: 105-108.

[11] ��Ծ��, ������, �°���. �˶���: һ����Ϊ�ָ���˶��������ݱ�ʾ����[J]. ������о��뷢չ, 2008, 45(3): 527-534.

YANG Yuedong, WANG Lili, HAO Aimin. Motion string: A motion capture data representation for behavior segmentation[J]. Journal of Computer Research and Development, 2008, 45(3): 527-534.

[12] Zhou F, Torre F, Hodgins J K. Aligned cluster analysis for temporal segmentation of human motion[C]//Proceedings of International Conference on Automatic Face & Gesture Recognition. Amsterdam, Netherland: IEEE, 2008: 1-7.

[13] Wang T S, Shum H Y, Xu Y Q, et al. Unsupervised analysis of human gestures[C]//Proceedings of IEEE Pacific Rim Conference on Multimedia. Beijing, China:Springer Berlin Heidelberg, 2001: 174-181.

[14] Wang M, Wang W, Li Y, et al. Motion capture data segmentation using kernel dynamic texture[C]//Proceedings of International Conference on Audio Language and Image Processing. Shanghai, China: IEEE, 2010: 592-596.

[15] Lu C M, Ferrier N J. Repetitive motion analysis: Segmentation and event classification[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2004, 26(2): 258-263.

[16] Lee J, Chai J, Reitsma P S A, et al. Interactive control of avatars animated with human motion data[J]. ACM Transactions on Graphics, 2002, 21(3): 491-500.

[17] M��ller M, Roder T, Clausen M. Efficient content-based retrieval of motion capture data[J]. ACM Transactions on Graphics, 2005, 24(3): 677-685.

[18] Singhal A. Modern Information Retrieval: A brief overview[J]. IEEE Data Engineering Bulletin, 2001, 24(4): 35-43.

[19] Marti A H. TextTiling: Segmenting text into multi-paragraph subtopic passages[J]. Journal of Computational Linguistics, 1997, 23(1): 33-64.

[20] Peter D T, Patrick P. From frequency to meanings: vector space models of semantics[J]. Journal of Artificial Intelligence Research, 2010, 37(1): 141-188.

[21] Scott D W. Multivariate Density Estimation: Theory, Practice, and Visualization. New York: John Wiley, 1992: 47-94.

[22] Lucas K, Michael G. Automated extraction and parameterization of motions[J]. ACM Transactions on Graphics, 2004, 23(3): 559-568.

[23] Eamonn K, Themistoklis P, Victor B Z, et al. Indexing large human-motion databases[C]//Proceedings of International Conference on Very Large Data Bases. Toronto, Canada:VLDB Endowment, 2004: 780-791.

[24] CMU Graphics Lab. CMU Motion Capture Database [EB/OL]. [2003-01-01]. http://mocap.cs.cmu.edu/.

[25] Miiller M, Roder T, Clausen M, et al. Documentation mocap database HDM05[R]. Bonn, Germany:  Bonn, 2007, 9-20.

Bonn, 2007, 9-20.

(�༭ �²ӻ�)

�ո����ڣ�2013-07-25�������ڣ�2013-09-10

������Ŀ��������Ȼ��ѧ����������Ŀ(61100143��61370128��61272353)���������������˲żƻ���Ŀ(NCET-13-0659)��������У����Ӣ�żƻ���Ŀ(YETP0583)���ߵ�ѧУ��������ҵ�����Ŀ(2012JBM124)

ͨ�����ߣ���ޱޱ��1980-�����������绯�ˣ������ڣ����¶�ý����Ϣ���������������о����绰��13691179189��E-mail: wwxing@bjtu.edu.cn