DOI: 10.11817/j.issn.1672-7207.2016.11.015

��������������SCM��۽�ͼ���ں��㷨

�������������ɣ��´���

(���������̴�ѧ ��Ϣ��ͨ�Ź���ѧԺ�������� ��������150001)

ժ Ҫ��

�ֲ���������е��ص㣬���һ�ֻ���ͼ����������������Ӧ���巢��Ƥ��ģ��(SCM)�Ķ�۽�ͼ���ں��㷨���÷�������۽�ͼ���ںϹ��̷�Ϊ2���Σ���1�λ���ͼ���Դͼ��ֲ����������Աȣ��ں���ͬ������Խ����Ȼ�����SCMģ�Ͷ�2��ͼ��IJ�����������ںϲ���Ӧ�����һ���ں���Ϊ�õ���ѵ�ģ���ںϲ������������������㷨��������Ѱ�ţ���Ϊ�������㷨��������ܲ���2���ԸĽ����ԡ�����ʵ�����3���ͼƬ���㷨������֤�������㷨��ȡ�ýϺõ��ں�Ч������֤���������㷨����Ч�ԡ�

�ؼ��ʣ�

��۽�ͼ���ں������巢��Ƥ��ģ���������������Ľ����������㷨��

��ͼ����ţ�TP391 ���ױ�־�룺A ���±�ţ�1672-7207(2016)11-3721-08

Multi-focus image fusion based on regional characteristics of SCM

BI Xiaojun, DIAO Pengfei, CHEN Chunyu

(College of Information and Communication Engineering, Harbin Engineering University, Harbin 150001, China)

Abstract: Considering our eyes are very sensitive on regional characteristics, a new fusion algorithm which combines regional characteristics and adaptive SCM is proposed. And the new algorithm has two steps to fusing image. Firstly, comparing the regional characteristics of the two images, and fusing the best area and the same area. Then, the difference area of image will be fused by SCM model. And a fusion standard was proposed. In order to select parameters of the model to get a better fusion image, an optimization algorithm was adopted and some improvements will be make to enhance searching ability. At last, experimental results show that the method can provide a best fusion quality in visual sense than other contrast algorithm.

Key words: multi-focus image fusion; spiking cortical model; regional characteristics; gravitational search algorithm

ͼ���ں�����Ϣ�ںϷ�������ͼ��Ϊ������о�����[1-4]�����������������õ�ͬһ������ͼ����Ϣͨ��һ�����㷨�����ۺϣ��Ӷ���ù��ڴ˳����ĸ�ȷ�����������У���۽�ͼ����ͼ���ں���һ����Ҫ���о����������ͬһ������ͬ�����ͼ���ںϳ�һ�����������۹۲��ͼ��ǰ������ͼ���ںϷ�����Ҫ��2�֣���Ƶ��[5-6]�Ϳռ���[7]���������������(pulse coupled neural network, PCNN)�����Ǹ��������Ӿ�����ϰ�߶������һ��������ģ�ͣ����һ��������㷺Ӧ����ͼ��������������ȱ������Ҫ�˹����õIJ����϶࣬�Ҳ�ͬ��������ϻ�Ӱ�����յ��ںϽ��[8]�����Ϊͼ���ںϵ�ǰ�ڹ��������˽ϴ�ļ��㸴�Ӷȡ����巢��Ƥ��ģ��(SCM[9]����PCNN�Ļ����������һ���µ�������ģ�͡���PCNNģ����ȣ�SCMģ������Ҫ��Ϊ�趨�IJ������٣�ģ��Ϊ��Ŀǰ�����������һģ�͵��о��Ÿո���WANG��[10]��SCMӦ����ҽѧͼ���ںϣ����WANG��[11]�����һ�ֻ������������ȵ�SCMͼ���ں��㷨�������Ϸ������ǻ���һ�����ص��ϸ������ںϵġ���������Ϊ��ʹͼ���ںϽ�����������۳���ϰ�ߣ����ںϹ��̷�Ϊ2���Σ���1�Σ�ͨ����2��ͼ��ľֲ�����ϸ�ڽ��жԱȣ�ȷ����2��ͼ���е���ͬ�����Լ���Խ����2�Σ�����SCMģ�����ʣ��ͼ����ںϣ�����Բ�ͬ�Ĵ����������һ�ֻ������������������ں������������д��ڵIJ��������һ�ָĽ������������㷨��������Ż���⡣ʵ�鲿���뼸�ֵ��͵�ͼ���ںϷ������бȽϣ���֤�˱��ķ�������Ч�ԡ�

1 ���巢��Ƥ��ģ��

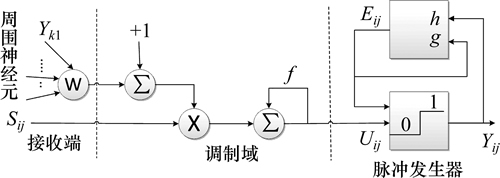

SCM�������ɸ���Ԫ���������ɵķ��������磬ÿһ����Ԫ���ɽ������Ʋ��ֺ����������3��������ɣ�������ͼ1��ʾ��

ͼ1 SCMģ��

Fig. 1 Model of SCM

��ԭ����ѧ���̿�����Ϊ

(1)

(1)

(2)

(2)

(3)

(3)

���У� Ϊ��Ԫ(i,j)�ڵ� n �ε���ʱ���ڲ���SijΪ�ⲿ������������ͼ����ڵ�(i,j)�������أ�

Ϊ��Ԫ(i,j)�ڵ� n �ε���ʱ���ڲ���SijΪ�ⲿ������������ͼ����ڵ�(i,j)�������أ� Ϊ��̬���ޣ�

Ϊ��̬���ޣ� Ϊ������������ڲ����Ͷ�̬��ֵ��������WΪ����Ȩ�ؾ���fΪ�ڲ�����˥��ϵ����g��h�ֱ�Ϊ��ֵ˥��ϵ������ֵ�Ŵ�ϵ����

Ϊ������������ڲ����Ͷ�̬��ֵ��������WΪ����Ȩ�ؾ���fΪ�ڲ�����˥��ϵ����g��h�ֱ�Ϊ��ֵ˥��ϵ������ֵ�Ŵ�ϵ����

��SCMδ������ʱ����Ԫ���ڲ��������Ϊ0�����ŵ������������࣬ ������������ÿ�������

������������ÿ������� ʱ�����������岢������״̬��SCM�е���Ԫͨ���ֲ���Ϲ���һ��ȫ�ֻ����������硣��ij����Ԫ���ڵ��״̬ʱ������������״̬���Ƶ�δ������Ԫ�ͻᲶ����������������ƺ������壬��ǰʵ�ֵ��

ʱ�����������岢������״̬��SCM�е���Ԫͨ���ֲ���Ϲ���һ��ȫ�ֻ����������硣��ij����Ԫ���ڵ��״̬ʱ������������״̬���Ƶ�δ������Ԫ�ͻᲶ����������������ƺ������壬��ǰʵ�ֵ��

2 ��������������SCMͼ���ں��㷨

��ͳ�Ļ��ڿռ����ͼ���ںϷ�������Ҫ�ǻ������ص����ͼ���ںϵģ������۵��Ӿ�ϵͳ��һ�����������״����Ϊ���У�������ڶ�۽�ͼ����ںϣ��ںϵ�Ŀ���ǵõ�һ������������ͼ������Ϊ�˱�֤���յ��ں�ͼ����������۹۲죬���Ľ��ںϽη�Ϊ2�������Ȼ���ͼ�����������ϸ�ڽ���������ںϣ�Ȼ�����SCMģ�����ͼ��ʣ�ಿ�ֵĵ���ںϣ����̵ľ������������ʾ��

2.1 ��������������ͼ���ں�

��ֲ�����İ뾶Ϊr��Ȼ�����μ���ÿ���ֲ������ϸ������������ѡȡ��ϸ������Ϊ�ռ�Ƶ�ʣ����Ƚ�2��ͼ���Ӧ�����ϸ���������ռ�Ƶ����������ͼ�������ԣ�ֱ����ͼ����������ء��ռ�Ƶ�ʽϴ������ںϽ��Я������Ϣ���ϴ������Ƚϸߡ��ռ�Ƶ�ʾ����ʾΪ

(4)

(4)

���У� Ϊͼ����

Ϊͼ���� ���ĻҶȣ�RZΪ��Ƶ�ʣ�CZΪ��Ƶ�ʣ�M��NΪ����ͼ��ijߴ硣

���ĻҶȣ�RZΪ��Ƶ�ʣ�CZΪ��Ƶ�ʣ�M��NΪ����ͼ��ijߴ硣

���õ�2��ͼ���Ӧ�ֲ������ϸ��ָ��ʱ�����ݱȽϽ�������ںϣ������������£�

1) 2��ͼ���Ӧ�ֲ�����ϸ����ȫ��ͬ���� ����˵��2��ͼ���Ӧ�����ϸ����ͬ��������ֱ����Ϊ�ں�����������Ա�����

����˵��2��ͼ���Ӧ�����ϸ����ͬ��������ֱ����Ϊ�ں�����������Ա�����

2) �����ھֲ�����ͼ��ϸ����ȫռ�ŵ����� ������žֲ������ܸ��˸��õ��Ӿ����ܣ����������Ϊ�ںϺ�����

������žֲ������ܸ��˸��õ��Ӿ����ܣ����������Ϊ�ںϺ�����

3) ����ͬʱ��2��ͼ���Ӧλ����ֵ��ͬ�Ķ���ͬʱ�����ĵ㣬�����2�������ںϡ�

2.2 ����SCM��ͼ���ں�

��1�������2��ͼ���еĽ����������ͬ������ںϣ�ʣ����ں�������2��Դͼ��֮����ڲ�������Ըò��֣����IJ���SCMģ�Ͷ�������ںϣ����ں�ǰ���Ƚ�������ںϵ�ͼ����Ϊ������Ϣ�滻2��ͼ��Ķ�Ӧ��������������������������ڴ��ں�ͼ������ĸ��ţ�����ں�������

�����ص���ʱ���ںϹ����������£�

1) ��ģ�͵�������ʱ����ô�������������ص㣬˵�����ڱ�Ե���־��и��ߵ����ȣ���˽��䱣��Ϊ���յ��ںϵ㡣

2) �Դ�������ͬ�����ص㣬���û��ڸ����ص����������ķ�ʽ�����ںϣ������ʾΪ

(5)

(5)

���У� Ϊ����(i,j)���ںϽ����

Ϊ����(i,j)���ںϽ���� ��

�� Ϊ�����ںϵ�2��Դͼ��

Ϊ�����ںϵ�2��Դͼ�� ��

�� Ϊ�ںϼ�Ȩϵ���������Ȩϵ���ǻ������������������м���ģ�����ǰ���ص�����������е�����Խ�࣬˵���������ͼ����ϢԽ�ḻ��������ںϹ����У�Ӧ���ؿ��Ǹ�����ʹ�����ںϹ�������������Ϣ��Ȩֵϵ���ľ�������������ʽ��ʾ��

Ϊ�ںϼ�Ȩϵ���������Ȩϵ���ǻ������������������м���ģ�����ǰ���ص�����������е�����Խ�࣬˵���������ͼ����ϢԽ�ḻ��������ںϹ����У�Ӧ���ؿ��Ǹ�����ʹ�����ںϹ�������������Ϣ��Ȩֵϵ���ľ�������������ʽ��ʾ��

(6)

(6)

(7)

(7)

(8)

(8)

���� ��

�� �ֱ�Ϊͼ��A��ͼ��B������(i,j)��������������EOL[12]��õ���

�ֱ�Ϊͼ��A��ͼ��B������(i,j)��������������EOL[12]��õ���

��������������SCMͼ���ں��㷨��������������£�

1) ��2�����ں�ͼ�������,��ʼ��SCMģ�͡�

2) ����2.1�������ķ�ʽ����ͼ����е�1�ε��ںϡ�

3) ���ںϺõ������滻2��Դͼ���ж�Ӧ������

4) ����SCM�����ٴ��ںϣ����ﵽ����������ʱ�����ڴ������ص㣬����2.2��������ʽ�����ںϡ�

3 ����Ӧ�����Ż�

��SCMģ���д��ڼ�����Ҫ�˹�ȷ���IJ���������������£�

1) fΪ�ڲ�����˥��ϵ�������Ĵ�С�������ڲ����Uij(n)��˥�������̶ȡ�

2) g��h�ֱ�Ϊ��ֵ˥��ϵ������ֵ�Ŵ�ϵ������ֱ��Ӱ����ֵ���ı仯�����

3) rΪ��ɵ�1���ںϵĹؼ�������ֱ��Ӱ���1�ε����������ںϡ�

4) Ϊ����Ȩϵ���IJ�����ֱ��Ӱ�����ص���ںϡ�

Ϊ����Ȩϵ���IJ�����ֱ��Ӱ�����ص���ںϡ�

��ͳ��ȷ�������ķ�����������ٷ��Լ�������������İ취�������ں�ǰ�ڻ�����ϴ�ļ��㸴�Ӷȣ��Ҹ��ݾ�������������Դˣ�Ϊ��ʡȥ�˹����Ƶĸ����ԣ�����㷨��ͼ���ں�Ч�������IJ��������Ż��㷨�Բ���������⡣GSA��2009�������һ�ֽ�Ϊ��ӱ�������Ż��㷨[13]�����������ٶȿ죬�������ȸ߶���������ר��ѧ�߹㷺��ע����˱��ij��Խ����������㷨��Ϊģ�Ͳ������Ż��㷨��

3.1 ���������㷨

��GSA�У���Ⱥ���嶼���ڿռ����˶��ĸ��壬���������������������±˴�������˶������ǵ����������������ӵı��������ϴ����ӵ�λ�ö�Ӧ���Ž⡣�ڽ��������У�GSA�㷨ͨ���������������������ʵ���Ż���Ϣ�Ĺ���������Ⱥ�������Ž������˶�չ��������

��ռ��к���N�����ӣ����i�����ӵ�λ��Ϊ

��i=1, 2, ��, N (9)

��i=1, 2, ��, N (9)

���У�nΪ�����ռ��ά���� Ϊ��i�������ڵ�kά�ϵ�λ����Ϣ����tʱ�̣�2�����Ӽ��������Ϊ

Ϊ��i�������ڵ�kά�ϵ�λ����Ϣ����tʱ�̣�2�����Ӽ��������Ϊ

(10)

(10)

���� ��

�� �ֱ�Ϊ����j������i����������Ϊһ����С�ij�����G(t)Ϊ��tʱ�̵������������������嶨��Ϊ

�ֱ�Ϊ����j������i����������Ϊһ����С�ij�����G(t)Ϊ��tʱ�̵������������������嶨��Ϊ

(11)

(11)

���У�G0Ϊ��ʼʱ�̵�����������TΪ�����������������ò�ͬ��T�ᵼ�����������Բ�ͬ�����Ƽ�С�� Ϊ����i������j֮���ŷ�Ͼ��롣����tʱ�̣�����i��kά���ܵ����������ӵĺ���

Ϊ����i������j֮���ŷ�Ͼ��롣����tʱ�̣�����i��kά���ܵ����������ӵĺ��� Ϊ

Ϊ

(12)

(12)

���У� Ϊ�仯������[0, 1]֮����������

Ϊ�仯������[0, 1]֮���������� Ϊ������j������i�ڵ�kά�ռ��ϵ�������������ţ�ٵڶ����ɣ�����tʱ������i��kά�ϵļ��ٶ��繫ʽ(13)��ʾ��

Ϊ������j������i�ڵ�kά�ռ��ϵ�������������ţ�ٵڶ����ɣ�����tʱ������i��kά�ϵļ��ٶ��繫ʽ(13)��ʾ��

(13)

(13)

�ڽ��������У����ӵ��ٶȺ�λ�õĸ��·�ʽΪ

(14)

(14)

���ӵ�����������Ӧ���йأ�����Խ������ӣ���������ӽ��������ӣ�����������ӵ���������ϴ������ƶ��ٶȻ���������������ļ��㷽ʽΪ

(15)

(15)

���У� Ϊ����i����Ӧ�ȣ�

Ϊ����i����Ӧ�ȣ� Ϊ������С���ӵ���Ӧ�ȣ�

Ϊ������С���ӵ���Ӧ�ȣ� Ϊ����������ӵ���Ӧ�ȡ�

Ϊ����������ӵ���Ӧ�ȡ�

3.2 �Ľ����������㷨

��GSA�㷨�У��������������ʹ��Ⱥ��ÿ�����ӵ��Բ��ϸ���λ�á��������Ž��˶�������λ����Ϣ��ÿһ�θ��£����ǿ������������ṩ�����������Խ����ģ���������ͨ��������������õļ��ٶ��DZ�֤��Ⱥ�����������Ž��˶��Ĺؼ�����������������ٶȹ���������������ʱ���ᵼ�¸���������ǰ�����ռ䣬�����������ӵ�ǰ�����ò������Ž⣻�����ٶȹ�С��������������Сʱ���ᵼ���㷨�����ٶ�����������������ͣ�͡���ˣ�������ٶ��Ƿ��ʺϵ�ǰ�����������ֱ��Ӱ���㷨�����Ž��������

Ϊ�˱�����ּ��ٶȲ����ڽ���������������������ĸ�����Ⱥ����������������Ӧ�������ӵ������ٶȵIJ��ԣ��Ա�֤���������ʺ��ڵ�ǰ�����ռ䣬���ڶ����Ž�����������ľ������ۺ�ʵ��ķ����Ƶ����������ٶȵ����ŵ������ԡ�

�� ��

�� ʱ���Լ��ٶ�����ʽ(16)������С��ֱ�������������Ϊֹ��

ʱ���Լ��ٶ�����ʽ(16)������С��ֱ�������������Ϊֹ��

(16)

(16)

�� ��

�� ʱ���Լ��ٶ�����ʽ(17)���зŴ�ֱ�������������Ϊֹ��

ʱ���Լ��ٶ�����ʽ(17)���зŴ�ֱ�������������Ϊֹ��

(17)

(17)

ʽ�У�l1��l2Ϊ��kά�����ռ�Ķ�̬�߽磬����ȡ�ж�����F1=1��F2=0.01�����ǵ����Ž����Ľ��У���Ⱥ�ķֲ�������ɷ�ɢ�Ĵ�������������С���������ʽ(16)�У���С����q1��(0, 1)֮����������Ե�������ʽ(17)�У��Ŵ�����q2��(1,10)֮����������Եݼ���ͨ����������������Ӧ�����ţ����Լ��ٶȶ�̬�ĵ�����ȷ���˼��ٶ�����ڵ�ǰ�����ռ䲻����ֹ�����С������������������㷨�����Ž������Ч��������

���⣬Ϊƽ���㷨��ȫ�����������;ֲ��������������IJ�������[14]����Ĵ��з����Եı�����ԣ������ʾ��ʽ(18)��ʾ

(18)

(18)

���У�r1��r2Ϊ����U(0,1)�ֲ����������

3.3 ��Ӧ�Ⱥ���

���������Ż��㷨��δ֪���������Ż�����ʱ����ҪΪ�㷨ȷ��Ŀ�꺯����Ŀ�꺯���뱣֤�������õ��IJ�����������ʹģ�͵��ں�Ч���ﵽ���ŵ����������ͼ���ں�����ָ���Ǻ���һ���㷨�ں�Ч�����ж����ݣ���˿���ѡ����ص����۱���ΪĿ�꺯������ͼ���ں�����ָ���У�ͨ��ͼ����������ָ��Q0[15]��Ҫ�������Ӿ����Գ���������2��ͼ��������ԡ����ȺͶԱȶ�3������IJ��죬�ܹ��Ϻ÷�ӳͼ�������Ƴ̶ȣ��Ҿ���ͨ���ԡ���ֵԽ���ʾ2��ͼ�����Ƴ̶�Խ�ߣ���˱���ѡ������ָ��Q0��Ϊ���ĵ�Ŀ�꺯����ͨ��ͼ����������Q0�������£�

���У�A��BΪԭͼ��FΪ�ں�ͼ�� ΪA��F���Э���

ΪA��F���Э��� ��

�� �ֱ�ΪA��F��ı��

�ֱ�ΪA��F��ı��

3.4 �㷨����

����1 �㷨�ij�ʼ�����趨��Ⱥ������N������ά��D����Ϊÿ�������������λ�á��ٶȣ��趨���������е�G0��a���涨����������T��

����2 ����ÿ���������Ӧ�ȣ��������ÿ���������ܵĺ������Լ���õļ��ٶȡ�

����3 �Եõ���ÿ��������ÿά�ϵļ��ٶȽ����жϣ����ڷ������������ӣ���������Ӧ�������Ӳ��ԣ���֤���Ӽ��ٶ��ں��������䷶Χ�ڡ�

����4 ����Ⱥ����ʽ(18)��ʾ�ı�����ԣ��������ǰ���бȽϣ���������ֵ��

����5 �ж��Ƿ�������ֹ��������������ת������2�����������������ֵ�ĸ��塣

4 ʵ�����

Ϊ����֤���������ں��㷨����Ч�ԣ�ѡȡ������������ͼ������ں�ʵ�飬ͼ���С��Ϊ512pixel*512pixel����1����Bottle�Ķ�۽�ͼ��2����CLOCK�Ķ�۽�ͼ�������PCNN��ͼ���ں��㷨�����ڲ��α任�������ں��㷨������˫ͨ��PCNN�������ں��㷨�Լ������ں�ȡ�����������ں��㷨������Ϊ�Ƚϱ��ĸĽ����������㷨����Ч�ԣ�������øĽ�ǰ�����������㷨�Ż������ķ�ʽ���бȽϡ�ͼ���ں����������ۺͿ�2������������۱Ƚϣ��������۲�ȡĿ��ķ�ʽ����Ҫ�����ں�ͼ��������ȡ�������ϸ�ڵı���Ч���� ѡ��Ŀ�����ָ���У�ƽ���ݶ�(AVG)���ռ�Ƶ��(SF)��Q0�Լ��ҶȾ�ֵ(MEAN)��AVG��Ҫ��ӳͼ���ϸ�ڵı�����������ֵԽ�����ʾ�ں�ͼ���ϸ�ڱ�������Խ�ã�������㷽ʽ���£�

MEAN��ʾͼ���ƽ�����ȣ�ӳ������������Խ�ߣ������۹۲�Խ���ʣ��������ʽΪ

���У�nΪͼ���к������ص�����xiΪ��i�����ص�����ء�

4.1 ��������

��Ⱥ��ģN����Ϊ30������ά������Ϊ5�����������㷨��������������Ϊ500��SCM�ĵ���������Ϊ40�� ��f ��g��ʼ����Χ������(0,1)�ڣ�r�İ뾶����������[3,64]��Χ�ڣ�h�ij�ʼ����Χ��[10,30]֮��,�����㷨�е���ز����ο�����[9]��

��f ��g��ʼ����Χ������(0,1)�ڣ�r�İ뾶����������[3,64]��Χ�ڣ�h�ij�ʼ����Χ��[10,30]֮��,�����㷨�е���ز����ο�����[9]��

4.2 ʵ���������

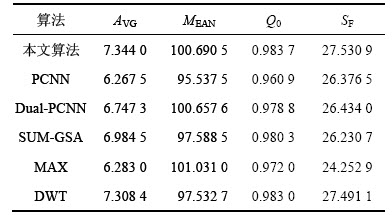

ͼ2��ʾΪBottle��۽�ͼƬ��ͼ���ںϽ�����Ը���ʵ����ںϽ�����������۵ĽǶȿ�����Ȼѡ��ʵ��ļ����ںϷ������ܱ��ֳ���۽�ͼ��۽�����Ҫ����������MAX�������ں�ͼ��������������Ƚϲ����PCNN��ͼ���ںϷ�������ϰ�������Dual-PCNN���ںϽ����2��Դͼ�ĸ��Եľ۽�������ȣ������������½���ֻ�л���DWT��ͼ���ں��㷨�ͱ����㷨�������Լ���������Ҫ������������ͼ���ں��㷨����1�����˱���ʵ��Ŀ����۽�����ӱ�1���Կ����������㷨��SUM-GSA�㷨����ڸ���ָ���Ͼ�������ߣ�֤���˱��ĸ�����GSA�㷨�Ľ�����Ч�ԣ���ָ��MV�ϲ��緽��MAX�ã�������Ϊ�㷨MAX���ںϹ����в��õ����ص��ں�ȡ��������ƽ���Ҷ�Ҫ��һЩ����������ָ���ϣ������㷨������MAX��������ָ��AVG��Q0�Լ�SF�������㷨��DWT�õ��Ľ������ֵ���������������ұ����㷨Ҫ����DWT�㷨����Ҳ֤���˱������᷽������Ч�ԡ�

ͼ2 Bottleͼ���ںϽ��

Fig. 2 Results of Bottle image fusion

��1 Bottleͼ��Ŀ�����ָ��

Table 1 Objective evaluation index of Bottle

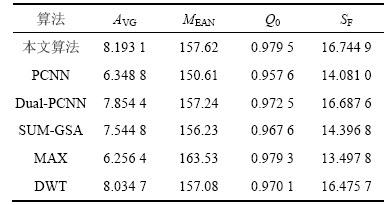

��2 CLOCKͼ��Ŀ�����ָ��

Table 2 Evaluation index of CLOCK

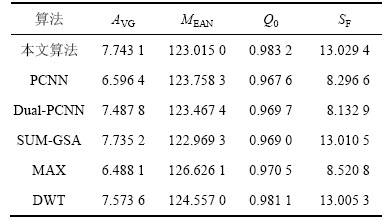

��3 Labͼ��Ŀ�����ָ��

Table 3 Evaluation index of Lab

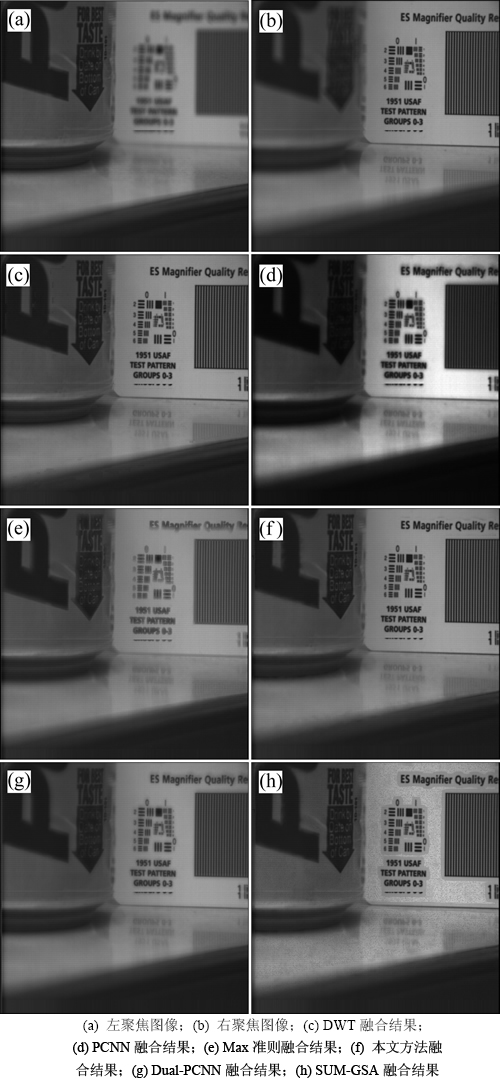

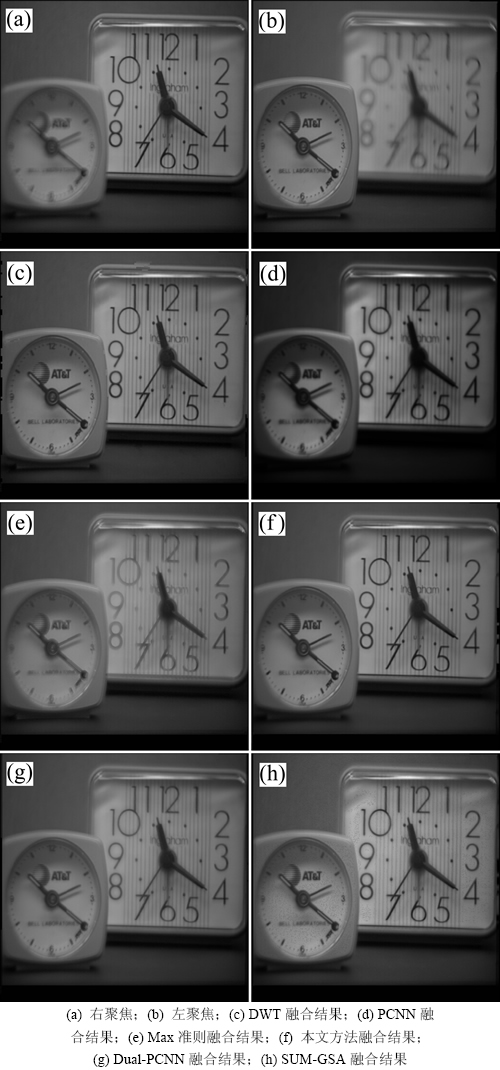

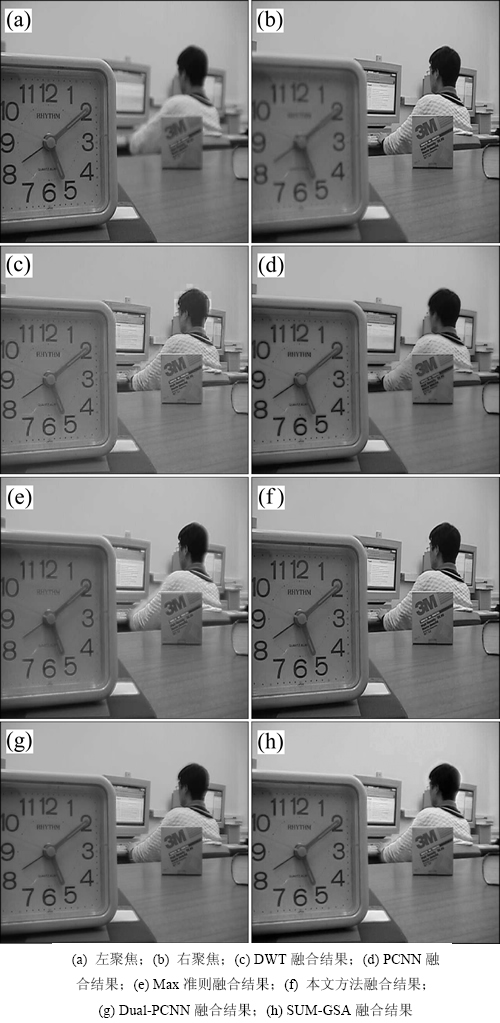

ͼ3��ʾΪCLOCK��۽�ͼƬ��ͼ���ںϽ�������������۽Ƕȿ��������ںϷ���������ʵ�ֶ�۽��ںϣ������Կ�����ͼ3(d)��3(h)�������Ƚϲͼ3(c)�Ҳ������������ʧ�棬�۲�ͼ3(g)�ᷢ�ָ�ͼ�д���һЩ��㣬ͼ3(e)�е���������ϲ�����ԱȲ����ԡ���ˣ�ͨ�������жϣ����������㷨���õ����ں�ͼ����нϺõ��������Լ���ϸ�ڵı���Ч�������ÿ����۱���һ����ͼ���ں�����������������2���������յĿ����۽�������ݱ�2�Ľ����Ȼ���Կ�����ָ����AVG��Q0�Լ�SP�ϣ����ķ���Ҫ���������㷨����ָ��MV�����ķ��������MVҪ��һЩ��������Ϊ����ȡ�����õ����ں�ͼ��������һ�������һЩ������ƽ���ݶȡ��ռ�Ƶ���Լ�Q0Ҫ��������������һЩ��

ͼ3 ��ͬ�ںϷ�����CLOCK�ں�ͼ��

Fig. 3 Fusion images of different fusion methods

ͼ4��ʾΪLab��۽�ͼƬ��ͼ���ںϽ�������������۽Ƕȿ��Կ����������ں��㷨����ɶ�2��ͼ��Ķ�۽��ںϣ�����DWT�㷨�õ����ں�ͼ�������Դͼ��ҶȽϰ���ͼ�������ͷ�������˿�ЧӦ����MAX�㷨�õ����ں�ͼ������������Ƚϲ�����㷨�õ����ں�ͼ�������DZ������ֻ�������������ϸ�ڱ��ﶼ���������㷨�õ����ں�ͼ��

���ÿ����۱���һ����ͼ���ں�����������������3���������յĿ����۽�����ɱ�3���Կ�����ָ����AVG��Q0�Լ�SP�ϣ����ķ���ȡ�ý��ŵ��ں�Ч������ָ��MV�����ķ���Ҫ����MAX�ںϷ���������ƽ���ݶȡ��ռ�Ƶ���Լ�Q0Ҫ��������������һЩ��

ͼ4 Lab��۽�ͼƬ

Fig. 4 Fusion images of Lab

�ۺ�����ʵ����Եó����ۣ�1) 3��ʵ����֤�˻�������������ͼ���ںϷ�������Ч�ԣ�2) �����GSA�㷨���в����Ż��ķ�����ȣ��Ľ�GSA�㷨���и��õ�Ч������֤�˱��Ķ�GSA�㷨�Ľ�����Ч�ԡ����ڲ����������Ż��㷨���ں�ģ�Ͳ�������������Ѱ�ţ���˸��Ӷȸ��������㷨��

5 ����

��������ں������ں����ϣ����һ�ֻ�����������������ӦSCMͼ���ںϷ��������������Ӿ���������������ص㣬��ͼ���ںϹ��̷�Ϊ2�����֣�Ϊ�˽����˹����ò����������ļ��㸴�Ӷȣ��������������㷨�����Ż�ģ���д��ڵIJ�����ʵ�������������������ںϷ������ں�ͼ������У�����������������и��õ�ϸ�ڱ�����������֤��������㷨����Ч�ԡ�

�ο����ף�

[1] REHMAN N, KHAN M M, SOHAIB M I, et al. Image fusion using multivariate and multidimensional EMD[C]// 2014 IEEE International Conference on Image Processing (ICIP). Paris: IEEEComputer Society, 2014: 5112-5116.

[2] MAURI G, COVA L, DE BENI S, et al. Real-time US-CT/MRI image fusion for guidance of thermal ablation of liver tumors undetectable with US: results in 295 cases[J]. Cardiovascular and Interventional Radiology, 2015, 38(1): 143-151.

[3] BAI Xiangzhi, ZHANG Yu, ZHOU Fugen, et al. Quadtree-based multi-focus image fusion using a weighted focus-measure[J]. Information Fusion, 2015, 22(3): 105-118.

[4] WANG Lei, LI Bin, TIAN Liangfang. Multi-modal medical image fusion using the inter-scale and intra-scale dependencies between image shift-invariant shearlet coefficients[J]. Information Fusion, 2014, 19(1): 20-28.

[5] ZHANG Baohua, LU Xiaoqi, JIA Weitao. A multi-focus image fusion algorithm based on an improved dual-channel PCNN in NSCT domain[J]. Optik-International Journal for Light and Electron Optics, 2013, 124(20): 4104-4109.

[6] ������, ������, �Ͽ�, ��. ���ڷ��²����������任��ѹ����֪��ͼ���ںϷ���[J]. ���������, 2014, 29(4): 585-592.

XING Yaqiong, WANG Xiaodan, BI Kai, et al. Fusion technique for images based on non-subsampled contourlet transform and compressive sensing[J]. Control and Decision, 2014, 29(4): 585-592.

[7] DAS S, KUNDU M K. A neuro-fuzzy approach for medical image fusion[J]. Biomedical Engineering, IEEE Transactions on, 2013, 60(12): 3347-3353.

[8] ����, ��С��. ����Ⱥ����ѧϰ����Ӧ˫ͨ���������������ͼ���ںϷ����о�[J]. ����ѧ��, 2014, 42(2): 217-222.

LI Yi, WU Xiaojun. A novel image fusion method using self-adaptive dual-channel pulse coupled neural networks based on PSO evolutionary learning[J]. Journal of Electronic, 2014, 42(2): 217-222.

[9] ZHAN Kun, ZHANG Hongjuan, MA Yide. New spiking cortical model for invariant texture retrieval and image processing[J]. Neural Networks, IEEE Transactions on, 2009, 20(12): 1980-1986.

[10] WANG Rui, WU Yi, DING Mingyue, et al. Medical image fusion based on spiking cortical model[C]//SPIE Medical Imaging. International Society for Optics and Photonics, 2013: 867610-867610-7.

[11] WANG Nianyi, MA Yide, ZHAN Kun. Spiking cortical model for multi-focus image fusion[J]. Neuro Computing, 2014, 130(3): 44-51.

[12] HUANG Wei, JING Zhongliang. Evaluation of focus measures in multi-focus image fusion[J]. Pattern Recognition Letters, 2007, 28(4): 493-500.

[13] RASHEDI E, NEZAMABADI-POUR H, SARYAZDI S. GSA: a gravitational search algorithm[J]. Information Sciences, 2009, 179(13): 2232-2248.

[14] ������, ������, Ф�. ���ڻ�ϲ��Ե����������㷨[J]. ϵͳ��������Ӽ���, 2014, 36(11): 2308-2413.

BI Xiaojun, DIAO Pengfei, XIAO Jing. Gravitational search algorithm with mixed strategy[J]. Journal of Systems Engineering and Electronics, 2014, 36(11): 2308-2413.

[15] ������. �ഫ����ͼ���ں����ۼ���Ӧ���о�[D]. ����: ���ϴ�ѧ���﹤��ѧԺ, 2010: 63.

LUO Xiaoqing. Study on the theory of multi-sensor image fusion and its application[D]. Wuxi: Jiangnan University. College of Biological Engineering, 2010: 63.

(�༭ �°���)

�ո����ڣ�2016-01-15�������ڣ�2016-04-09

������Ŀ(Foundation item)��������Ȼ��ѧ����������Ŀ(61175126)�������У��������ҵ���ר���ʽ���Ŀ(HEUCFZ1209) �ߵ�ѧУ��ʿѧ�Ƶ�ר��(20112304110009) (Project(61175126) supported the National Natural Science Foundation of China; Project(HEUCFZ1209) supported by the Fundamental Research Funds for the Central Universities; Project(20112304110009) supported by the Special Scientific Research Foundation of the Doctoral Program of Higher Education)

ͨ�����ߣ�����������ʿ�����ڣ�������Ϣ���ܴ��������������Ż��㷨������ͼ�����о���E-mail: 398317196@qq.com

ժҪ��������۶�ͼ��ֲ���������е��ص㣬���һ�ֻ���ͼ����������������Ӧ���巢��Ƥ��ģ��(SCM)�Ķ�۽�ͼ���ں��㷨���÷�������۽�ͼ���ںϹ��̷�Ϊ2���Σ���1�λ���ͼ���Դͼ��ֲ����������Աȣ��ں���ͬ������Խ����Ȼ�����SCMģ�Ͷ�2��ͼ��IJ�����������ںϲ���Ӧ�����һ���ں���Ϊ�õ���ѵ�ģ���ںϲ������������������㷨��������Ѱ�ţ���Ϊ�������㷨��������ܲ���2���ԸĽ����ԡ�����ʵ�����3���ͼƬ���㷨������֤�������㷨��ȡ�ýϺõ��ں�Ч������֤���������㷨����Ч�ԡ�